奇偶派(jioupai)原創

作者 |葉子

編輯 |釗

圖源:圖蟲創意

隨着2024年的鐘聲即將敲響,站在這個歷史的節點上,回望過去一年,發展、進步、改變、革新最大的行業非人工智能莫屬,AI的快速進步如同翻江倒海一般,激蕩着無數的可能性。

其中,2023年裏國產大模型的噴湧出現和快速發展,作爲最引人矚目的焦點,爲我們每個人的工作與生活帶來前所未有的新奇體驗,並开啓了一波AI發展的浪潮。

它們的出現,標志着人工智能從單一的任務處理,朝着多任務、復雜任務甚至多模態任務處理的方向邁進。這些大模型不僅能夠理解和生成人類的語言,還能夠理解和生成圖像、視頻等多種類型的數據,甚至能夠在多個任務之間進行遷移學習,展現出了驚人的靈活性和適應性。

然而,能力的躍遷進步,並不意味着大模型的發展就能一帆風順。

龐大的參數量和計算需求,使得訓練和部署這些大模型成爲了一項極具挑战性的任務,而國產大模型在算力層面被封鎖、的情況下則顯得更加窘迫。同時,大模型強大的能力與真正落地生產生活也有着不小的距離,如何能將其快速、准確、低成本地投放至應有之處,也成爲了衆多大模型廠商們思考的問題。

盡管如此,我們不能否認大模型帶來的巨大潛力。它們爲我們打开了一個全新的世界,讓我們有機會以前所未有的方式理解和利用數據。

那么,回望2023年,在AI發展的三駕馬車——算力、數據、算法上,“國產派”遇到了哪些問題,取得了哪些突破,又有着怎樣的思考?在百模大战甚至千模大战的背景下,各家廠商推出了怎樣的大模型?面對大模型能力投放難、落地難的問題,企業又該如何解決呢?

1

大模型三駕馬車發展情況

在前置端,算力、數據、算法作爲大模型的三大支柱,都是不可或缺的因素,在2023年中,它們在各自的道路上都有着長足的進步,也面臨着不少的發展困難。

其中,算力作爲實現大模型的基礎,發展基調可以用“外部制裁,內部發展,夾縫求生”來概括。

2022年8月底,美官方命令芯片廠商英偉達停止向中國銷售部分高性能GPU,而另一家超威半導體也收到了相關的禁止命令。

而在一年之後的10月17日,美國商務部繼續延長了2022年10月首次實行的全面出口管制,繼續收緊對尖端人工智能芯片的出口管制,在新規之下,英偉達旗下最新的H200自然無望賣給中國,就連在去年新規管制之後專門爲中國設計的“特供版”GPU A800與H800,也將無法進口。

同時,伴隨着管制規則的更新,除去直接可用的產品外,還擴大了芯片制造工具出口限制清單,中國的兩家國產GPU制造商——摩爾线程、壁仞科技均被列入“實體清單”,大模型發展的必備算力,受到了極大的限制。

但也正是在此次禁令的推動之下,國產GPU芯片終於不再被NV與AMD兩家“騎在頭上”,得到了快速發展的最佳窗口期,其中華爲昇騰、寒武紀思元等國產加速芯片也在本次禁令的推動之下迎來春天。

在與華爲有關人士的交流中,對方表示,華爲昇騰910於2019年發布,並於今年10月發布了最新的910B芯片,相比於上一代獲得了FP32的性能提升。而科大訊飛副總裁江濤在Q3業績說明會也透露,目前華爲昇騰910B能力已經基本做到可對標英偉達A100。

但在談及昇騰910B的應用時,對方也表示昇騰還有着許多急需進步的地方,例如當前的互聯網公司更加追求性價比和易用性,而目前華爲的服務器產品還是以鯤鵬爲基礎,導致了業務遷移的高成本,所以目前還處於前期的POC階段,真正的上量起碼要在2024年或更久的未來。

除被認爲是“中國NV”的華爲昇騰外,被稱作“中國AMD”的寒武紀也在加碼AI算力芯片的研發和推進。

圖源:IPO聚焦

據媒體報道,百度內部的測試結果顯示,寒武紀最好的產品思元590,最高性能已經接近A100 90%的性能,綜合性能也與A100 80%的水平相差無幾,但由於寒武紀採用了ASIC的架構,導致通用性較差,當前仍然無法大規模地投入到訓練之中。

而在華爲與寒武紀之外,其實還有很多很多的國產廠商在大力推進AI芯片的發展,譬如海光的DCU、天數智芯的天垓100、燧原的雲燧、璧仞的BR100,都有着很強的競爭力,作爲後發者,雖然在能力和適用性上與英偉達最新的加速卡相比可以稱得上有天壤之別,但也在通過不斷的技術創新和市場拓展,展現出自身的競爭力。

與國產廠商大力推進AI芯片進步的同時,面對着當下海量的需求和短期內只會越來越強的AI芯片封禁,中國幾大公有雲廠商也在通過“集中算力,以雲代卡”的方法解決算力問題。

“集中算力,以雲代卡”,顧名思義,就是將很多AI芯片匯集到一處地方,再通過雲的方法將算力傳輸至需要的地方,這樣可以提高算力基礎設施的質量與效率、實現資源的優化配置與共享,這也是爲什么2023年中小企業很難拿到加速卡,而是由幾大公有雲廠商競爭搭建算力池的原因。

根據IDC數據,2023上半年中國AI服務器已經使用50萬塊自主开發的AI加速器芯片。華爲已經推出昇騰AI雲服務,提供自主AI算力服務。在東數西算背景下,各地建立一批採用自主AI算力的AI計算中心,保障雲端AI算力穩定可靠供給。

總的來說,算力作爲被圍追堵截最嚴重的地方,2023年國產大模型廠商們也在東拼西湊之中拮據存活了下來,但面對着越拉越大的算力差距,將會更明顯地成爲中國AI追趕世界頂尖水平的絆腳石,所以在未來算力層面的企業也將會被多次拉出炒作,可注意相關投資機會。

如果說算力決定了大模型是否能面世,那么數據才是決定大模型優質與否的關鍵要素。

所有人都明白,數據數量越多越好、數據多樣性越多越好、數據質量越高越好,所以目標是一致的,而方法也相差不大。

圖源:圖蟲創意

而目前國內科技互聯網頭部企業主要基於公开數據及自身特有數據差異化訓練大模型, 譬如百度文心主要依靠的是萬億級別的網頁數據、搜索數據,阿裏通義則主要來源於阿裏達摩院,騰訊混元的訓練數據大多取自微信公衆號、微信搜索等處,但此類信息大多都有着互聯互通,所以截至目前,國內大模型整體的數據規模、質量也不會相差甚遠。

但有一個在發展第一年中尚未察覺的隱患,那就是高質量的語言數據與圖像數據或將耗盡,據機構預測,全球英文語言數據將於2030~2040年耗盡,其中能訓練出更好性能的高質量語言數據將於2026年耗盡。

與英文語言數據相比,中文優質數據集更加稀缺,盡管國內數據資源豐富,合成數據也有不少,但由於挖掘不足導致優質數據無法在市場上自由流動,未來如果廠商想要大模型更進一步,或許就需要將資金投入至尋找優質數據的道路中,未來手握巨大優質數據的如知乎、豆瓣等企業,與挖掘、合成數據的企業,也將獲得一定的發展空間。

而在算法層面,當前許多都是基於谷歌提出的Transformer模型構建的,仍在不斷地更新迭代中,但這並非是一定一成不變或必須要走的道路。

在AICC 2023人工智能計算大會上,浪潮信息人工智能軟件研發總監吳韶華表示,如果想接近甚至超越GPT4的能力,一定要同時考慮算法和數據。首先是算法,不能一味地使用LIama結構或者Transformer結構,而不做任何創新。

譬如,在考慮到算力不足之時,在相同的架構下可以盡可能地降低參數量,這樣能提升參數效率,也能節省算力,相當於從算法層面考慮算力的开銷,而此類算法更新改進的思路,也是大廠們一直在做的事情。

2

模型進步雙輪驅動 基礎與行業並重

而在底層技術迭代的同時,各家大模型不斷地發布自然成爲了最引人注目的事情。

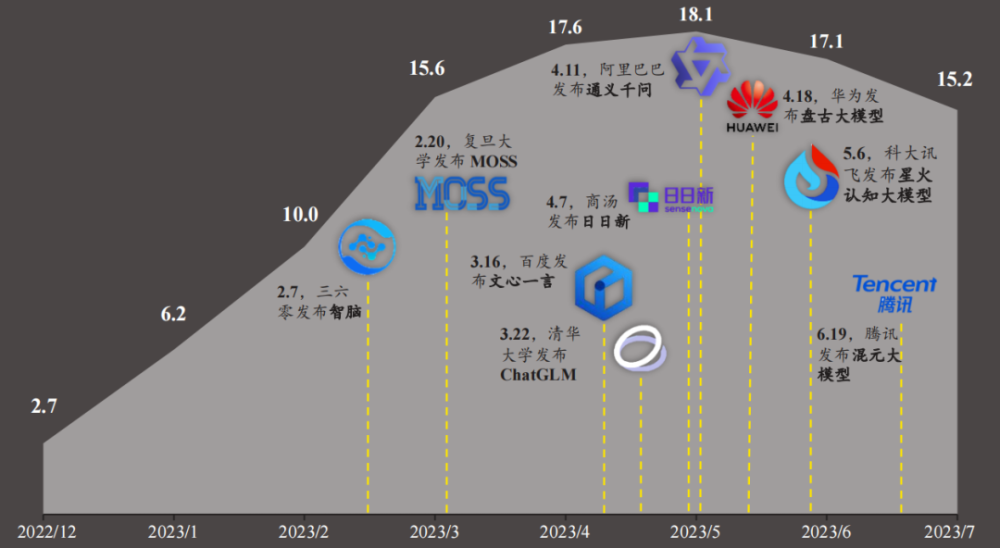

繼3月百度發布文心大模型以來,圍繞在我們耳邊的一直就是華爲、阿裏、騰訊等互聯網大廠,三六零、科大訊飛等AI企業,還有清華大學、復旦大學等高校科研機構推出的大模型及相關升級進展,截至目前,市場上出現的各類大模型已經超過240個,正在供用戶們使用。

圖源:頭豹研究

但這么多的大模型,從屬性上來進行區分,一般都可以分爲基礎大模型和行業大模型兩大類。

其中,基礎大模型是指通用性強、適用範圍廣的大模型,可以用於多個領域和任務,也可以在其基礎上進行特定數據的訓練與調教,使其變爲朝向某個方向或某個行業的專用大模型。

但基礎大模型的入場門檻較高,往往需要大量的計算資源和訓練數據方可進行开發和優化。以當前國內能力最強的基礎大模型——文心大模型爲例,其參數量已經飆升至萬億級別,相關算力也是由萬卡AI集群提供,相關的成本大幅增加。

同時,在具體的落地使用方面,很多人會發現歷經一年打磨、升級後的文心4.0、迭代後的通義千問、進步後的混元大模型的能力與一些行業專有大模型甚至都有着一定的差距,便認爲基礎大模型的能力或許沒有那么重要,訓練好每個行業的大模型快速應用於生產中才是正道,但這樣的想法是十分錯誤的。

與行業大模型相比,基礎大模型的參數量超過某個閾值後,AI效果將不再是隨機概率事件,此時再將其訓練爲行業大模型,將更容易獲得准確的結果。同樣的,基礎大模型也是其下所有行業模型的中心與核心,只要“大腦”有任何哪怕一丁點進步,都會引起整個模型群能力的提升,以百度爲例,文心大模型4.0升級將會提升所有千帆智能平台上的行業模型的落地能力。

此外,行業模型大多依靠人工標注與調優,有着成本高、周期長、效率低的缺點,但基礎大模型則能夠進行自我學習、自我監督、自我更正,可以顯著地加速訓練成果,還能總結不同情況下的通用能力,如此訓練才有機會讓電影裏無所不知的人工智能的落地成爲真正的可能。

所以說,在基礎大模型尚不牢靠之時,就放棄基礎大模型的探索轉向行業大模型的發展實在是有“短視”之嫌,持續加碼基礎大模型的或許將爲未來行業大模型的發展起到事半功倍的作用。

但作爲門檻極高、花費極大的賽道,就交由大廠們去卷吧,而我們在2023年中也能欣慰地看到,BAT、華爲等大模型第一梯隊企業,在布局行業大模型、應用生態的過程中,並沒有放松加速迭代基礎大模型的速度,而未來伴隨着基礎大模型的突破,中國大模型的能力有機會得到“飛升”的機會。

不過,基礎大模型的建設固然重要,但是並不影響行業大模型的發展,與之相反的是,在巨大對於大模型能力的需求之下,年內,在金融、消費、能源行業中,都有着十分優秀的落地案例。

在金融行業中,百度旗下度小滿以“通用大模型+自有行業數據”的方式構建了金融行業的垂直大模型“軒轅”。

在金融應用場景中,傳統的通用大模型由於其訓練數據很少接觸金融行業內的專業術語、業務邏輯和公式計算,導致其在具體問題上表現不佳。

而“軒轅70B”的強項就在於其專業的金融能力,受益於預訓練和微調階段中海量金融專業語料庫的訓練,無論是注冊會計師考試(CPA)、銀行/證券/保險/基金/期貨從業資格、理財規劃師、經濟師等金融領域十大類權威考試,都能提供專業的支持和解答。

圖源:頭豹研究院

但軒轅能扮演的角色更像一個助手,提供的價值更多停留在工具層。而在未來,伴隨着金融行業大模型數據合規、隱私安全等問題得到解決後,將會應用於交互性更強的場景,賦能金融行業的數字化發展。

而在泛消費領域中,阿裏、京東等依靠電商起家的大廠,都有着客服機器人、營銷數字人等行業大模型的應用。

在電商中,客服一直是最爲依賴人工的環節,在雙十一、六一八等購物節期間,需要24小時保持即時回復,也因爲依賴人工,導致客服團隊的效率極低、難以滿足客戶需求。

但今年雙十一期間,京東與淘寶等平台都引入了智能客服,以京東爲例,“京小智”可以幾十分之一人工的價格,爲用戶提供即時的服務,而在接入京東言犀大模型後,可以與消費者絲滑交流。

在智能客服外,在直播中京東數字人也讓人眼前一亮,其形象可以根據企業需求進行定制,音色、形象、身高、體型等項目都可以根據企業需求進行個性化設置,可以與真人主播搭配輪班,甚至完全替代真人主播。

京東數字人

此外,導購服務也是大模型接入電商行業後帶來的新功能,今年9月淘寶接入通義千問後,淘寶問問可以面向C端用戶提供智能導購服務,只要消費者問出相關問題,AI可以迅速給出所需購买的產品、相關視頻介紹、商品鏈接等,成爲新的流量入口,讓商家、平台和消費者完成三贏。

而在更加“硬核”的能源行業生產場景中,華爲與商湯科技等廠商則有着很深的造詣。

在能源電力行業中,從業者過去常常面臨一個問題,如何將在能源緊缺時分配至最需要的地方,又如何在能源充裕時儲存起來,這就涉及到了虛擬電廠的調度問題了,而引入大模型後,可以對電力供給、需求端進行精確的把控,起到“削峰填谷”的作用。

據頭豹研究院報道,目前華爲、商湯科技等廠商开發出的針對電力行業的AI大模型已經投入了應用中。

例如,華爲基於L1級別盤古電力大模型,推出無人機電力巡檢、電力缺陷識別等場景模型。商湯科技則基於AI大模型的底座,提供電力系統大模型解決方案,向電力能源行業持續輸出高質量的AI算法和算力,賦能電力系統多域智能化升級。

這樣的行業大模型及具體的應用還有很多很多,而這只是其能力落地的第一年,未來還會有更多的應用出現在我們身邊,並伴隨着大模型能力的進化而不斷迭代,並經歷神化到祛魅的完整過程,真正成爲人類的最好幫手。

3

雲模結合的新投放方式——MaaS加速生長

伴隨着2023年中各家大模型的密集發布與快速成長,一個新的問題擺在了各家大廠的面前,那就是如何將大模型的能力簡單快速地投送至其應處的地方,畢竟如果在產業落地的環節出了問題,那么有關大模型的一切都只是空談。

但也就在此時,MaaS(Model as a Service)——模型即服務的概念,火了起來。

MaaS是指將大模型封裝成可調用的雲服務,通過雲計算平台提供給用戶使用,這種服務化的模型部署方式通過將模型和計算資源放置在雲端,用戶可以通過簡單的API接口調用模型,無需關注底層的模型訓練和部署細節,同時可以根據需求自動擴展計算資源,實現彈性擴展和高可用性。

而像MaaS這樣將AI同雲結合後再投放的形式,無論從需求、供給還是已有的雲基礎設施建設來看,都有着出現的必然性。

從需求端來看,當前企業仍然處於朝向數智化轉型的階段中,許多生產場景都如幹涸的土地一般,在等待人工智能的雨露助力效率的提升;而在供給端,受計算資源與存儲資源的影響,無法做到“家家有卡,人人會用”,只能採用集中算力再投放的方法;而在基礎設施端,在過去十年中,我們已經搭建起了一套有關雲的完整體系,而MaaS剛好可以作爲SaaS的替代品接替上位。

於是,截至目前,幾乎所有兼備雲和大模型的廠商都發布了自己的MaaS平台——百度千帆、字節火山方舟、騰訊雲MaaS平台、阿裏雲MaaS平台......都已經推出。

以百度千帆爲例,其內置了百余款Prompt模板,包含對話、編程、電商、醫療、遊戲、翻譯、演講等十余個場景,相關企業可以直接選擇某一個模型或者在已有模型的基礎上再根據自身的要求加入數據進行微調。

騰訊雲MaaS的服務也大抵相同,可爲金融、文旅、傳媒、政務、教育等10大行業提供了超過50個大模型解決方案,供客戶調用。

而在百度與騰訊之外的其他MaaS平台,建設思路與打法也都大同小異,都是利用基礎設施和行業理解的優勢,提供一整套的开發工具與套件,保證不同體量不同需求客戶的完美交付。

但是,2023年MaaS的發展還遠遠稱不上完備,最多只能說是搭起了往後發展的模板,仍然還有着很多很多需要更迭的地方。

其中最讓廠商們頭疼的點,就是基礎大模型與行業大模型之間的鴻溝。俗話說的好,“三百六十行,行行出狀元”,但在現實生活的行業中遠遠不止這個數字,讓大廠們去卷基礎大模型還好,但要讓那數萬甚至數千的开發人員去接觸每一個行業,定制每一個方向的專用大模型,無異於癡人說夢。

而這就需要真正的從業人員參與到其中,但這個難度也着實不小,可以說這個問題還將困擾廠商、行業甚至社會很久很久的時間。

此外,MaaS本身作爲一種雲服務模式,算力是其提供服務的基礎,隨着MaaS的發展,雲服務市場對算力的需求呈現爆發式增長趨勢,廠商們尚未跑通的商業化邏輯、大模型逐漸增長的數據還有價格逐漸增加的算力,成爲了限制MaaS發展的一大難題。

而在這兩大痛點之外,用戶的教育也需要時間來堆砌。

據腦極體報道,包括了數據標注、訓練、評估、測試和部署等全套工具的騰訊雲TI平台,即使交到了行業客戶和夥伴手中,沒有技術專家深入指導,沒有產品經理、項目經理、運營、程序員等手把手教學,很難搞定定制化需求。

但無論怎么說,MaaS這樣的服務模式正處於發展的早期階段,尚未形成較爲成熟的模式,未來大廠們若跑通商業模式,算力緊缺問題有所解決,客戶教育逐漸進步,屬於MaaS的春天才正式來到。

4

寫在最後

2023年,對於國產大模型的發展來說是充滿機遇與挑战的一年。在算力、數據、算法等“AI三駕馬車”的推動下,國產大模型取得了顯著的進步,但同時也面臨着諸多困難。

但令人欣慰的是,大模型作爲這樣一個新興事物,快速完成了商業模式的基礎閉環,雖然當前仍有重重困難,但在起步之年能做到此種程度已經體現了國內互聯網、科技大廠們的實力。

而在未來,伴隨着底層技術、大模型能力、投送能力和商業化模式的進一步發展,人工智能將不斷深入我們的生活當中,成爲每個人都可借用的強大生產力工具。

參考資料:

1.《MaaS,雲廠商在打一場“翻身仗”》,腦極體;

2.《雲計算服務新範式:MaaS有望改變雲服務廠商的商業模式》,賽迪顧問;

3.《英偉達A800、H800將被出口管制,國產GPU能否頂起一片天?》,科技雲報道;

4.《AICC圓桌對話:打破跟隨,實現大模型創新能力突破 》,科技知多少;

5.《數據要素專題研究報告:大模型與數據共振,數據要素市場方興未艾》,國金證券;

6.《2023年中國AI大模型應用研究報告》,頭豹研究院。

原文標題 : “文心、通義和混元”們的2023:道阻且長,仍向遠方

標題:“文心、通義和混元”們的2023:道阻且長,仍向遠方

地址:https://www.utechfun.com/post/313043.html