你敢相信嗎,一個普通的視頻聊天,竟然讓一位福州市民損失了430萬元!這就是最近發生的一起利用AI技術實施電信詐騙的驚人案例,它引發了全國網友的熱議和關注。

而在國外,有關AI造假的問題也是層出不窮。有人用AI技術制造了美國前總統特朗普“被捕”的假新聞,也有人用AI技術模仿了歐盟委員會主席的聲音,向德國總理打了個騙局電話。

這些新聞表明,AI技術的濫用和誤用已經成爲一個全球性的問題,在這種情況下,人們越來越擔心 ChatGPT 等人工智能的發展可能對社會帶來嚴重的威脅。對此,包括“ChatGPT之父”Sam Altman在內的350位AI權威自發籤署了一封聯名公开信,警告AI可能會對人類構成滅絕性風險。

此前,深度學習之父Hinton也曾爲了警告AI的風險,不惜從谷歌離職。的確,AI技術的發展和應用不僅給人們帶來了便利和福祉,也帶來了巨大的挑战和危機。

如何識別和應對AI的潛在風險,已經成爲當下亟待解決的問題,而我們將在以下內容中針對這些問題做詳細的闡述。

AI有哪些風險?

? 倫理和道德風險

想象一下,如果有一天,AI技術發展到了超越人類智慧的水平,它會怎么對待我們?它會尊重我們的價值觀和利益嗎?它會保護我們的主體地位和自由嗎?科幻小說中人類的機器大战的場面是否會成爲現實?

這是我們需要認真思考的一個非常重要的問題,因爲在AI技術的發展和應用中,倫理和道德風險已經悄然出現。

一方面,AI系統可能成爲人類偏見的鏡子或放大器,導致不公平的決策或行爲;另一方面,AI系統可能區別對待不同的個人或群體,比如有些招聘系統可能會針對某些性別或種族,從而影響他們的就業前景。

? 經濟風險

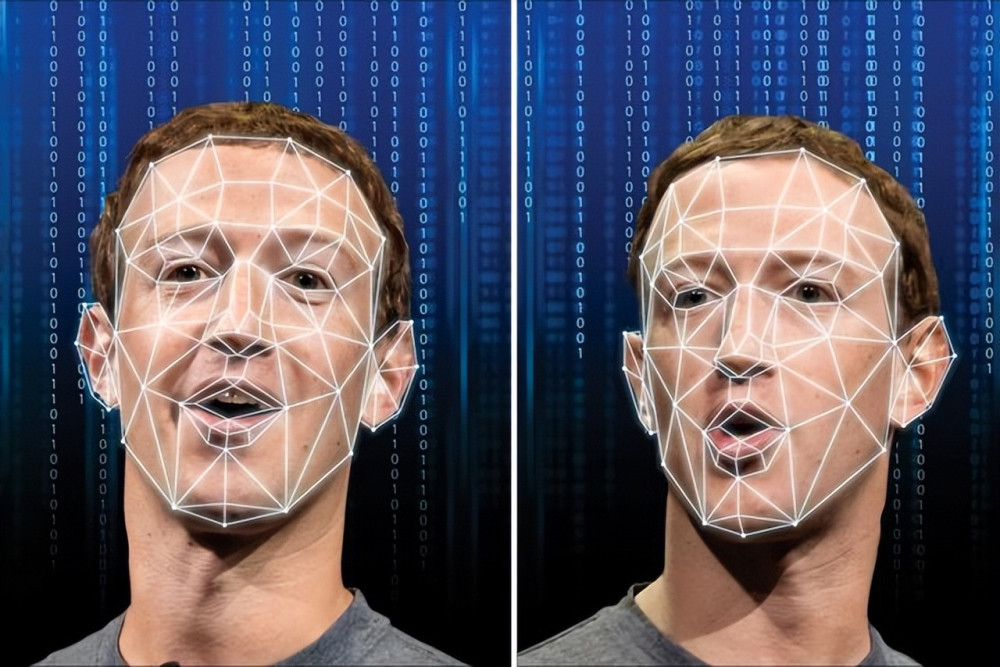

AI技術所引發的經濟風險也與我們的生活息息相關。詐騙分子通過“換臉”和“擬聲”等技術模仿受害人的朋友或親戚的聲音和外貌,讓受害人完全分不清真假,這便是利用AI技術進行詐騙的典型方式。

據報道,這種詐騙的成功率高達100%,已經造成了多起重大財產損失,給人們帶來了嚴重的經濟風險。

目前,AI詐騙包括以下幾種常用手法:

聲音合成:詐騙者通過騷擾電話錄音等來提取某人聲音,獲取素材後進行聲音合成,從而可以用僞造的聲音騙過對方。

AI程序篩選受害人和換臉技術:詐騙分子首先分析公衆發布在網上的各類信息,然後根據所要實施的騙術,通過AI技術篩選目標人群,最後在視頻通話中利用AI換臉騙取信任。在短時間內便可生產出定制化的詐騙腳本,從而實施精准詐騙。

轉發微信語音:詐騙分子在盜取微信號後,便向其好友“借錢”,爲取得對方的信任,他們會通過提取語音文件來實現語音轉發,進而實施詐騙。

? 技術風險

作爲一種改變人們生活方式和工作方式的技術,AI的廣泛應用爲人們帶來了極大的便利,但同時AI技術的發展也給人類帶來了一系列的技術危害和技術風險。

首先是數據隱私和安全問題。AI技術需要處理的數據通常涉及到用戶的個人信息,如果這些數據處理不當或泄露,將給用戶帶來巨大的損失和安全隱患。

其次,AI技術往往採用黑箱技術,以獲得更高的預測能力和效率,這使得AI系統不能向人類提供足夠的可解釋性,使得AI系統無法“解釋”其行爲或決策的標准,可能產生誤導性和歪曲性。

除了以上技術問題以外,清華大學教授陶建華曾表示,大模型的安全漏洞威脅大模型的應用生態和國家安全,如數據投毒攻擊、對抗樣本攻擊,以及模型竊取攻擊國家、企業、個人信息竊取等。

? 社會風險

AI技術的不斷發展還導致了越來越多的工作被自動化取代,部分人失去了工作機會,從而使得富人和窮人之間的差距越來越大。

在某些行業中,AI可能會取代人類工作崗位,如制造業、商業、金融和法律,這會導致失業、職業轉移和社會經濟的重大變化,進一步造成失業率上升,並對整個社會產生負面影響。

除此之外,AI可能對人類的社交和人際交往能力產生影響。在未來,人類可能會傾向於與機器對話,而不是與真正的人進行交流,這將對我們的社會聯系和人類身份認同帶來重要的改變。

如果AI技術變得足夠智能,可能會超出人類的控制範圍,從而導致不可預測的人類控制喪失。最後,由於人工智能技術的發展需要大量投資和技術資源,可能會導致一些國家或組織比其他國家或組織更具競爭力,從而加劇社會不平等。

該如何應對?

? 國家層面

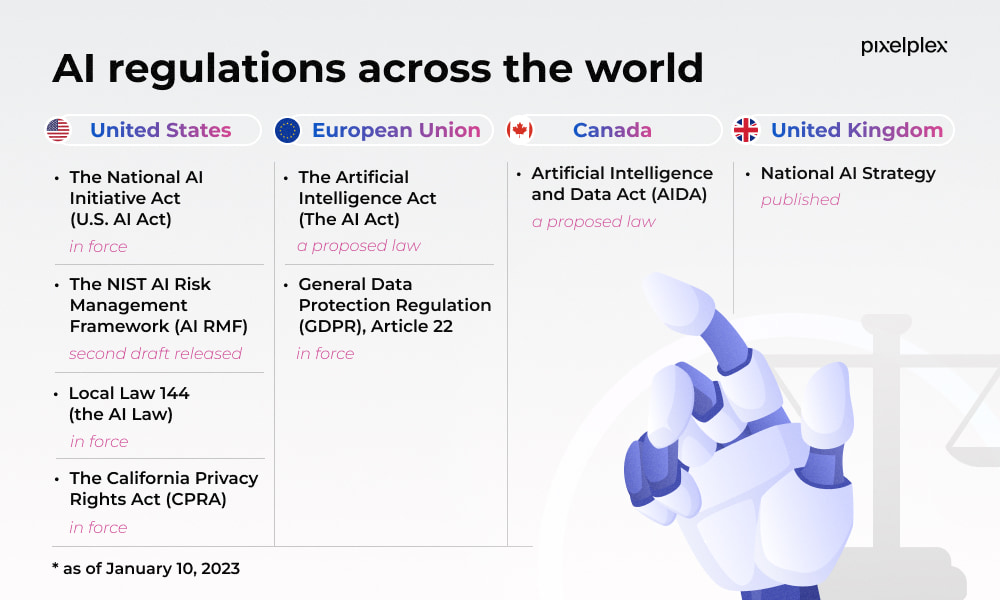

盡管人工智能技術具有跨國性質,並且圍繞它的擔憂程度很高。在AI監管方面,自2017年以來,69個國家共通過了800多項人工智能法規。

但在人工智能監管或數據使用方面仍然沒有統一的政策方法,那么,世界各地的政府機構是如何處理這個問題的呢?

世界各地的政府機構正在努力制定人工智能監管和數據使用方面的政策。例如,英國宣布將舉辦世界首個人工智能峰會,呼籲加強AI管制。美國國家標准與技術研究院也已經制定了負責任地使用人工智能的方法框架,並試圖在政府的AI監管工作方面扮演突出角色。

歐盟委員會提出了一項旨在加強人工智能(AI)技術監管的法規草案,擬創建一個所謂“AI高風險應用場景”的清單,並對AI技術在關鍵基礎設施、大學招生、申請貸款等被認定爲“高風險”應用領域的开發和使用制定新的標准,並進行有針對性的監管。

此外,中國政府也在積極推進人工智能監管和數據使用方面的政策,中國國家互聯網信息辦公室發布了《人工智能安全評估規範》等文件,以加強對人工智能安全性的監管。

在近日國務院辦公廳印發的《國務院2023年度立法工作計劃》中,人工智能法草案等也將預備提請全國人大常委會審議。

由此可見,國家政府機構在處理人工智能監管或數據使用方面問題時,通常會制定一些法規或指南來規範相關行爲。這些法規或指南通常會涉及到人工智能技術的安全性、隱私保護、公平性、透明度等方方面面。

? 企業層面

爲了更好地應對AI所帶來的風險,不只是國家層面,還需要使用AI技術的相關企業也做出努力。

如今,AI已在許多企業內外納入應用層面,其中的一個重要布局是與大數據相結合,能夠實現智能營銷、分析需求、提升服務、改進供應鏈等。

但應用該技術也暴露出不少弊端,即使是ChatGPT也存在不知道實時信息的局限性,更多依賴AI可能會招致黑客攻擊。最優的選擇便是用最新的算法更新系統,實現“技術爲王”。

此外,針對AI技術衍生的部分道德倫理問題,比如自動篩選與分類容易導致歧視與偏見,以及面部識別技術可能會暴露人的隱私等,企業在其中往往扮演主要角色。

不可否認,逐利是企業的天性,但作爲社會的一員,企業還應承擔相應的社會責任,合法使用用戶數據並保障知情權,主動建立企業內部監管機制,主動接受國家與社會的監督。竭澤而漁,顯然不是市場競爭的長遠選擇。

? 個人層面

目前AI詐騙的新聞大多集中於個人案例,因此每個人都應當提高防範能力,包括反詐意識與技術知識。

我們不僅要對陌生網址、短信、電話、好友保持警惕,更要對熟人在網絡上突如其來的匯款請求與提供個人隱私信息的要求提高警覺。

當無法見面核實真實情況時,請拒絕涉及隱私與財產的要求,一旦發現風險,請第一時間尋找有關部門的幫助。

(在某社交平台查詢到的個人經歷分享)

了解AI前沿技術同樣能夠提高個人反詐能力。一個人很難賺到認知之外的錢,同樣,也難以丟掉認知之內的錢。雖然中老年人容易因不熟悉網絡而被詐騙,但實際上AI詐騙早已滲透年輕一代裏。詐騙者往往利用被詐騙者的自信自負、虛榮愛面子、撿漏撈偏門等心理,從而達到其目的。

理性對待AI風險

我們必須要意識到,人工智能的發展對人類社會是一把雙刃劍。AI到今天已成爲不可逆的社會潮流,但現有與潛在的風險需要我們提前預防。

英國阿斯頓大學學者大衛·科林格裏奇曾提出,創新技術如果因爲擔心後果採取提早控制,那么很可能就不會爆發,如果控制過晚,就很可能會走向失控。AI失控此前只存在於科幻作品中,但近來諸如“AI將會毀滅人類”的言論甚囂塵上,引發的詐騙、隱私等問題也暴露無遺。

想要突破AI的科林格裏奇困境,需要國際組織、國家機關、企業團體與個人聯合努力,攜手並進。

在社會高速公路上急馳AI,急停只會造成難以估量的損失,我們要做的,唯有勻速向前。

【聲明】:本文爲元宇宙之心運營團隊原創,未經允許嚴禁轉載,如需轉載請聯系我們,文章版權和最終解釋權歸元宇宙之心所有。

原文標題 : AI風險堪比核能?詐騙、失控等衆多黑暗面,我們該如何應對?

標題:AI風險堪比核能?詐騙、失控等衆多黑暗面,我們該如何應對?

地址:https://www.utechfun.com/post/223615.html