正在上演,該公司的競爭對手並未坐以待斃,正加緊開發、推出產品。美國 AI 新創 Anthropic 開發的 Claude 系列模型已被數百萬人廣泛使用,新版本 Claude 2.1 透過 API 提供給客戶,並支援的對話體驗。

Anthropic 21 日釋出 Claude 2.1 模型為用戶帶來關鍵功能的進步,包括領先業界的 200K token 上下文長度、模型幻覺率顯著下降、系統提示以及測試版新功能。

現在 Claude Pro 用戶轉發給 Claude 的資訊量可增加一倍,上下文長度從 100K token 提升至 200K token,相當於 15 萬個單字或超過 500 頁的資料,也勝過 模型的 128K token。換句話說,用戶現在可以上傳整個程式碼庫等技術文件、S-1 等 SEC 規範的財務報表,甚至是《伊利亞德》或《奧德賽》等長篇文學作品,利用 Claude 摘要重點、回覆問答、對比多個文件等等。過往需要幾個小時的人力才能完成的任務,透過 Claude 只要幾分鐘就能完成。

根據用戶需求,Anthropic 為 Claude 2.1 模型添加所謂「工具使用」(tool use),這是一項測試版新功能,可讓 Claude 與用戶現有流程、產品和 API 整合,使 Claude 在日常操作更有用處。Anthropic 還為 Claude 引進新的「系統提示」(system prompts),允許用戶向 Claude 自訂指令,設定有用的上下文,強化 Claude 具有特定個性和角色的能力。

Our new model Claude 2.1 offers an industry-leading 200K token context window, a 2x decrease in hallucination rates, system prompts, tool use, and updated pricing.

Claude 2.1 is available over API in our Console, and is powering our chat experience.

— Anthropic (@AnthropicAI)

▲ Anthropic 釋出 Claude 2.1 模型。

Anthropic 設計大量複雜的事實問題來測試 Claude 2.1 模型誠實性,這些問題探討目前模型已知的弱點。與先前 Claude 2 相比,Claude 2.1 虛假陳述減少 2 倍,這使企業能夠建立高效 AI 應用程式,解決具體業務問題。

Claude 2.1 模型在理解和歸納方面做出改進,特別是對於冗長且複雜文件可做出準確處理,比方說財務報告、法律文件、技術規範等。在 Anthropic 評估中,Claude 2.1 證明錯誤答覆減少 30%。

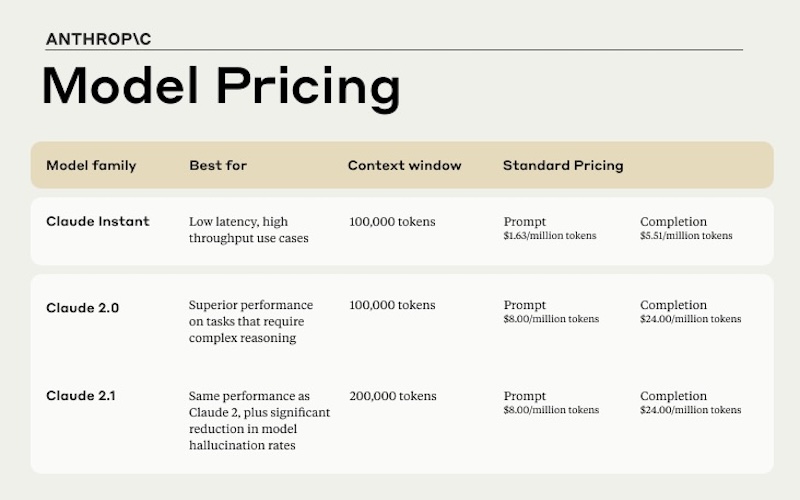

▲ Anthropic 也更新收費計價,提高客戶跨版本採用的成本效率。

從 Claude 2 開始已向台灣使用者開放測試,能以繁體中文輸入使用。Anthropic 強調以負責任態度開發 Claude 並減少技術偏見。除了 ChatGPT、Bard 以外,也值得試試 Claude。

(首圖來源:)

延伸閱讀:

標題:Claude 2.1 模型釋出,上下文長度翻倍至 200K token

地址:https://www.utechfun.com/post/294067.html