模型層進入“平台期”的當下,小模型的出現,無疑爲市場打开了新的可能。

大模型之战進入到今日,許多开發者都面臨着一個共同的挑战:如何在保證高性能的同時,降低資源和算力的需求?

這一困境在端側應用尤爲明顯,因爲許多設備和應用場景對計算能力和存儲空間有嚴格的限制。這無疑大大制約了大模型在各種設備和場景中的普及。

如何突破這一桎梏,實現性能與資源的完美平衡,從而打开潛在的市場?

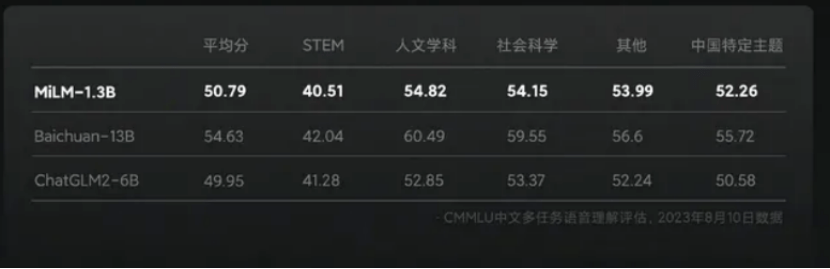

近期,一些小型模型,如Mistral AI推出的Mixtral8x7B和微軟發布的Phi-2,提供了一個可能的解決方案。

這些小模型在參數規模上相對較小,但在性能上卻表現出了驚人的實力,甚至在某些方面超越了Llama2等規模更大的競爭對手。

而這也意味着,套在很多場景上的“參數枷鎖”,也將有望被打破。一個新的增量市場,已經呼之欲出。

01 以小博大

從技術上說,Mistral 和Phi-2的特點就是一個詞:短小精悍。

Mistral 8x7B由來自歐洲的Mistral AI打造,採用了稀疏混合專家模型(SMoE)技術,結合了多個針對特定任務訓練的較小模型,提高了運行效率。

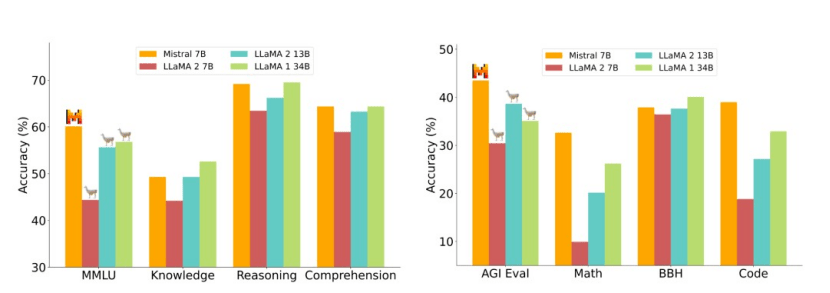

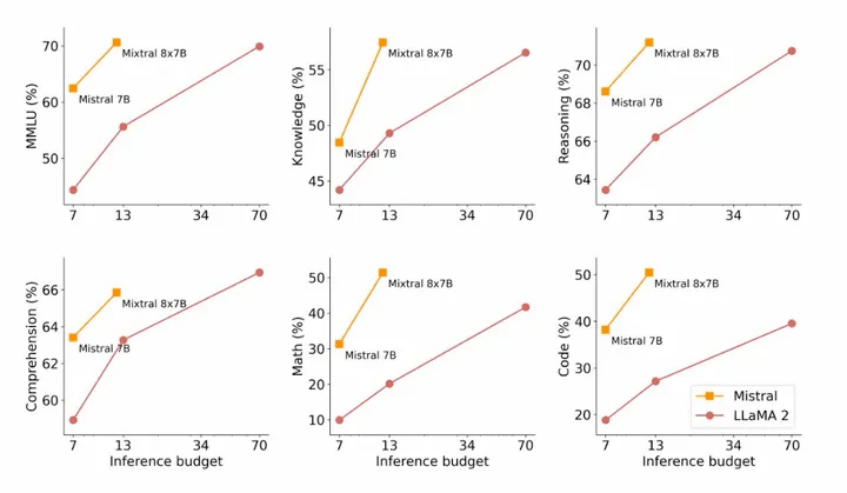

在許多基准測試中,Mistral 8x7B的性能已經達到甚至超越了規模是其25倍的Llama2 70B。

而微軟推出的Phi-2雖然規模更小(僅27億參數),但得益於“教科書質量”數據的訓練,以及學習其他模型傳遞的洞見的技術,目前已在某些基准測試中超過了更大的模型,如 70億參數的Mistral和130億參數的Llama2。

Mistral 7B在所有基准測試中超越了Llama2 13B

那么,這些異軍突起的小模型,將會給已進入“平台期”的模型層,帶來怎樣新的想象?

具體來說,針對目前大模型的種種局限,小模型至少在兩個方面實現了逆襲。

其中一個方面,就是其橫向擴展了模型的使用範圍,打开了之前因資源、算力而被束縛的市場。

以手機市場爲例,根據Statista的數據,2021年全球智能手機用戶數量已達到約39億。

然而,小打开手機大模型的市場,卻絕非易事。

由於手機設備上的內存和計算能力有限,爲了平衡內存佔用、執行速度和功耗,目前手機廠商普遍採用端雲協同的解決方案,但這並非長遠之計。

對於手機廠商來說,使用雲端資源會產生額外的成本。隨着用戶規模的擴大,這些成本可能會不斷增加,從而限制了其盈利規模的上限。

因此,最好的選擇,就是能讓手機在本地就能運行一款參數不大,但性能又能與雲端大模型媲美的小模型。

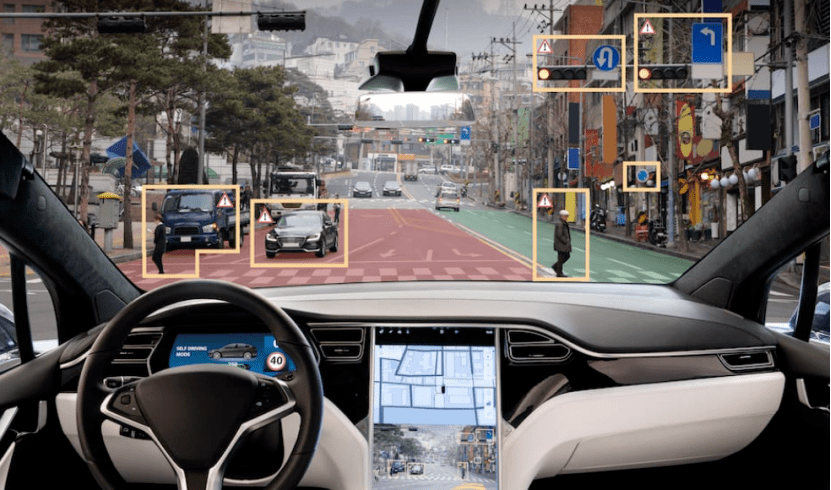

同樣地,在一些需要快速部署,實現實時響應的邊緣場景,例如自動駕駛、物聯網(IoT)中,實時決策和數據處理就顯得至關重要。

根據ResearchAndMarkets的報告,全球自動駕駛汽車市場規模在2020年達到了約558億美元。預計到2027年,這一數字將增長至約5,260億美元。

目前的車載計算平台,如英偉達的DRIVE AGX Orin,計算能力是254 TOPS(每秒254萬億次操作),在高速公路等相對簡單的場景中,由於數據量和計算復雜度較低,其算力並不是很喫緊。

然而,在更復雜的城市駕駛場景中,自動駕駛系統需要處理更多、更復雜的數據和任務,如實時檢測和識別各種障礙物、預測其他道路用戶的行爲、規劃安全路徑等。

在這種情況下,有限的算力,就會限制自動駕駛的進一步普及。

Mistral和Phi-2這類小模型由於其較小的模型體積和較低的計算需求,可以在這些有限資源下高效運行。

因爲車載系統需要在有限的能源和散熱條件下運行,而較低的計算需求還有助於提高處理速度,實現實時決策和響應。

這一點對於推動自動駕駛和智能座艙技術的發展具有重要意義。

02 通向Agent之路

除了打通原先被限制的市場外,Mistral和Phi-2這類小模型的另一大逆襲之處,就是其與Agent的關系。

Mistral AI的CEO Arthur Mensch曾言:讓模型變小一定會有助於Agents 的开發和應用。

而在模型層鮮有重大突破的今天,越來越多的人已經意識到:Agent就是大模型的未來。

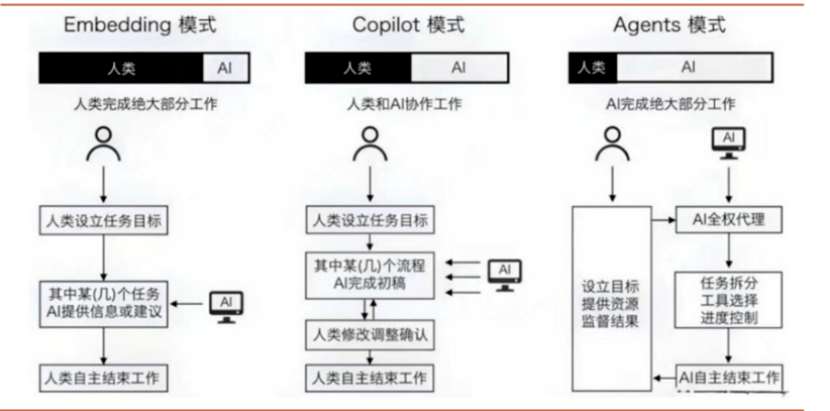

對比AI與人類的交互模式,目前已從過去的嵌入式工具型AI(例如Siri)向助理型AI發展,目前的各類AI Copilot不再是機械地完成人類指令,而是可以自動化地完成各種人類工作流,

如果說Copilot這類生成式AI是“副駕駛”,那么Agent則可以算得上一個初級的“主駕駛”。

比爾·蓋茨曾言:在計算行業中,平台是應用程序和服務構建的基礎技術。Android、iOS 和Windows都是平台的例子。而Agent將成爲下一個平台。

到了那時,要創建一個新的應用或服務,你不需要掌握編程或圖形設計技能。Agent將能夠幫助處理幾乎所領域的事務。

那么Arthur Mensch爲什么會斷言小模型一定會有助於Agents的开發和應用?

這裏主要有兩個原因:一是推理成本,二是模型復雜度。

在推理成本方面,除了絕對數值外(即每1000個Token的成本),更重要的,是模型的推理預算與實際效能之比。

從目前的情況來看,Mixtral擁有46.7B的總參數量,但每個token只使用 12.9B參數,也就是說,Mixtral的實際執行速度和所需的成本和一個12.9B的模型相當。

下圖展示了官方公布的模型生成質量與推理消耗成本的關系,與Llama2相比,Mistral7B和Mixtral8x7B表現出自己高能效的優勢。

這意味着,與大模型相比,在保持高效能的情況下,Mixtral這類小模型通常需要更少的計算資源和時間來進行推理,因此更加適合用於實時交互和在线學習。

其次,小模型也有助於Agents的开發和應用,因爲它們通常具有更低的模型復雜度,更容易被理解和調試。

Arthur Mensch對此談到:當人們走向一個Agents和AI交互的世界,系統的復雜性也會因此大幅增加。這種高度復雜的情境可能導致崩潰(Collapse),即機器學習中的一種一切都停滯不前的狀態,如果沒有足夠的自組織和解決問題的意愿,人們可能無法有效地應對和管理這些挑战。

爲了解決這個問題,需要在設計和實現AI系統時充分考慮系統的可擴展性、模塊化和可解釋性。

而小模型通常具有更簡單的結構和更少的參數,這使得具有更好的可調試性,從而便於讓开發人員更容易理解和控制模型的性能,從而更快地將Agents推向市場。

03 新的勝出者

在模型層市場被少數頭部企業左右的當下,小模型的出現,無疑爲市場打开了新的可能。

從總的態勢來說,之後的模型層競爭中,小模型可能會對大模型形成一種“農村包圍城市”的態勢。

“農村”象徵着小模型主要佔據的應用領域。這些領域通常包括資源受限的環境,如物聯網設備、智能家居、移動設備和邊緣計算場景。

在這些領域,小模型的靈活性、低成本和低能耗等特點使它們具有競爭優勢。此外,小模型在定制化和遷移學習方面的優勢,使它們能夠更好地適應各種細分市場和特定任務。

“城市”則象徵着大模型主要佔據的應用領域。這些領域通常包括計算資源豐富、對性能要求較高的場景,如數據中心、雲計算和高性能計算環境。

在這樣的態勢下,憑借着細分市場的優勢,以及开源社區的協作和共創,小模型在性能上會不斷迭代,並逐漸對大模型主導的領域形成一種“鉗制”的優勢。

這種關系,類似於農村爲城市提供糧食等資源,維持城市的正常運行。在AI領域,大模型在特定領域的優化和提升,將愈發難以脫離小模型提供的實踐場景和技術支持。

而面對這樣的態勢,頭部的大模型企業,自然也不甘被鉗制,因此,這些大廠可能的應對之策之一,是通過蒸餾(Distillation)或者合成數據(Synthetic data generation)等技術來訓練出質量更高的小模型。

或者更簡單粗暴一些,直接將小模型團隊收購、兼並,爲己所用。

在這樣的情況下,未來小模型領域,怎樣的企業更有可能勝出?

就大小模型的差異而言,小模型並不像大模型一樣,需要龐大的算力、數據作爲支撐,在這個領域,更考驗的是對技術的理解,以及深厚的理論基礎。

因此,將來在小模型領域,更有可能脫穎而出的團隊,應該會是那些具有強大學術、技術背景,且一线研究者、技術人員具有更大話語權的企業。

例如這次的Mixtral的團隊Mixtral AI, 就是由DeepMind和Meta的三位青年科學家建立。

聯創三人,Arthur Mensch,CEO,前DeepMind研究科學家;Guillaume Lample,首席科學家,前Meta研究科學家,Llama項目帶頭;Timothee Lacroix,CTO,前Llama工程帶頭。

在創立Mistral前,Arthur Mensch在DeepMind任職,並主導了LLM、RAG、多模態三個領域最重要的論文,十分全能。

對一线研究者而言,唯有自由地踐行自己的技術構想,在初期不過多地被資本幹涉與左右,才更有可能做出亮眼的成果。

原文標題 : 異軍突起的小模型,有多大想象空間?

標題:異軍突起的小模型,有多大想象空間?

地址:https://www.utechfun.com/post/304895.html