北京時間 12 月 14 日凌晨,OpenAI CEO Sam Altman 在 X(Twitter)上發布了一則推文,正式宣告重新开放 ChatGPT Plus 新用戶訂閱。按照 Altman 的說法,核心原因是 OpenAI 已經找到了更多的 GPU,原文是:we found more gpus.

就在 1 個月前,也是 Altman 宣布暫停 ChatGPT Plus 新用戶訂閱(20 美元/月,約合人民幣 141 元/月),理由是「开發日後使用量的激增超出了我們的承受能力,我們希望確保每個人都有良好的體驗。」

即使對於風頭正盛的 OpenAI 來說,這也不是一件易事。

要知道,頂級 GPU,或者是算力早就成爲了科技公司的一種战略資源,甚至是吸引頂級研究人員的「利器」。公开報道指出,作爲全球英偉達 H100 GPU 儲備第二多的公司,Meta 已經將大量 H100 作爲吸引頂級 AI 人才的招聘策略。

難怪 Altman 新推文下面有網友再次感嘆道:「GPU 是新的石油。」

圖/ X(Twitter)

但算力依然受限,核心是大模型訓練、推理都嚴重依賴於英偉達高端 GPU,而英偉達又受限於台積電先進芯片制造工藝、封裝工藝以及韓國 HBM 內存的產能。

說到底,還是算力不夠用,「供給」趕不上「需求」。這不僅是 OpenAI 一家公司,也是整個 AI 行業所面臨的危機。但現在 OpenAI 重新开放了 ChatGPT Plus 訂閱,又是否意味着行業已經走出了算力短缺的危機?

並不盡然。

自始至終,OpenAI 都沒有明確指出所謂「找到」,是指從「算力之王」英偉達購买到了更多的英偉達 GPU,還是從「幕後大佬」微軟那裏拿到的支持,又或是從「最強備胎」AMD 买到最新一批的 AI 芯片 Instinct MI300X。

但至少可以肯定,算力市場正在經歷一輪洗牌。

英偉達的對手們

一周前,谷歌 DeepMind CEO Demis Hassabis 代表 Gemini 團隊正式推出了全新一代多模態大模型 Gemini,擁有「視覺」和「聽覺」,還有強大的學習和推理能力。其中,Gemini Ultra 直接對標公認最強大的 GPT-4 模型,行業推測參數超萬億。

更耐人尋味的是,在一衆基於英偉達高端 GPU 訓練出的大模型中,Gemini 是唯一一個完全基於自研 AI 芯片—— TPU 訓練出的萬億參數大模型。

TPU v5p 集群,圖/谷歌

從單片性能來看,不管是 TPU v5e、v4 還是最新發布的 v5p 其實都遠不是英偉達 H200、H100 的對手。以谷歌最新的 TPU v5p 爲例,INT8 下的峰值算力僅爲 918 TFLOPs,遠低於上一代英偉達 H100 的 1979 TFLOPs。

但就像半導體研究機構 Semianalys 首席分析師 Dylan Patel 指出的,「對人工智能基礎設施來說,系統能力比微架構更重要。」通俗來講就是,芯片集群的算力比單塊芯片的算力更重要。

在大模型訓練、推理的大規模計算之中,單塊芯片計算完成後需要進行通信,但受制於通信效率實際往往無法做到全部傳輸,這就意味着部分算力被浪費了。行業搶購英偉達 GPU 除了因爲最成熟的 CUDA 生態,在於單塊更強 GPU 提供的效率提升,更在於英偉達 NVLink、NVSwitch 等通信技術可以實現芯片集群的算力最大。

圖/英偉達

而谷歌自研 TPU 一开始的目的就是用在全球數據中心,不可能不重視多芯片互連技術。事實上,谷歌也沒有公布訓練 Gemini 使用的 TPU 數目,而是強調動用了不只一個集群,甚至不只一個數據中心。

不僅如此,谷歌還宣稱,包括 Salesforce 和 Lightrick 等客戶已經在使用谷歌雲的 TPU v5p 超級計算機來訓練大模型。

谷歌之外,微軟在 11 月舉辦的 Ignite 大會發布了自研 AI 芯片——Maia,亞馬遜也於同月舉辦的 re:Invent 大會上推出自研 AI 芯片——AWS Trainium2。不過,目前亞馬遜、微軟都還沒有推出基於自研 AI 芯片訓練的大模型,更多還是用於大模型的推理,但也有 AI 獨角獸 Anthropic 宣布了基於 Trainium2 構建模型的計劃。

圖/亞馬遜

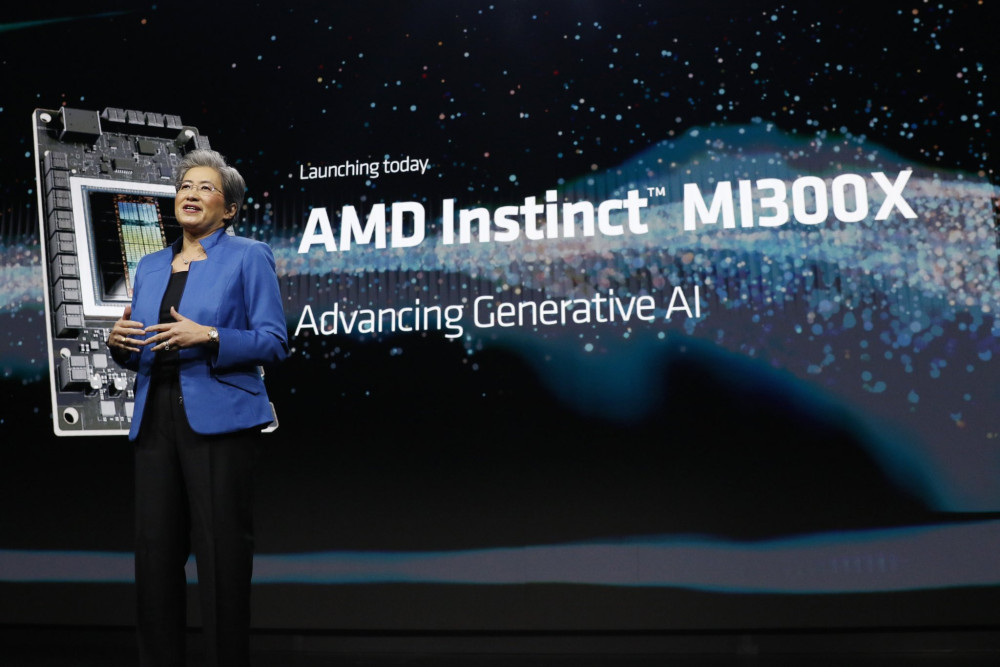

不同於雲計算三巨頭的競爭,英偉達老對手、芯片巨頭 AMD 則在本月初的 Advancing AI 發布會上,正式推出了高端 GPU Instinct MI300X(以下簡稱 MI300X),谷歌、亞馬遜、微軟、OpenAI、甲骨文、Meta、戴爾、惠普、聯想等公司紛紛爲其站台。

生態上,AMD ROCm 雖然相比英偉達 CUDA 生態還有不小的差距,但 AMD 也借助整個行業加注「備胎」的風向緊趕慢趕,而且 AMD CEO 蘇姿豐今年早些時候就表示,她不相信在 AI 芯片市場發展如此之快的情況下還會有什么「護城河」一說。

與此同時,微軟、Meta 也都承諾購买 MI300X 用於 AI 計算需求,甲骨文甚至提前先採購了一批。另據供應鏈傳聞,微軟爲此還提前一步砍掉了英偉達的部分訂單。

王權沒有永恆

衆所周知,GPU 最初的目的就是爲遊戲和視頻進行圖像渲染。但前英偉達首席科學家戴維·柯克(David Kirk)一直有個夢想——將主要服務於圖像渲染的 GPU 算力「通用化」,使之轉變爲通用算力中心。

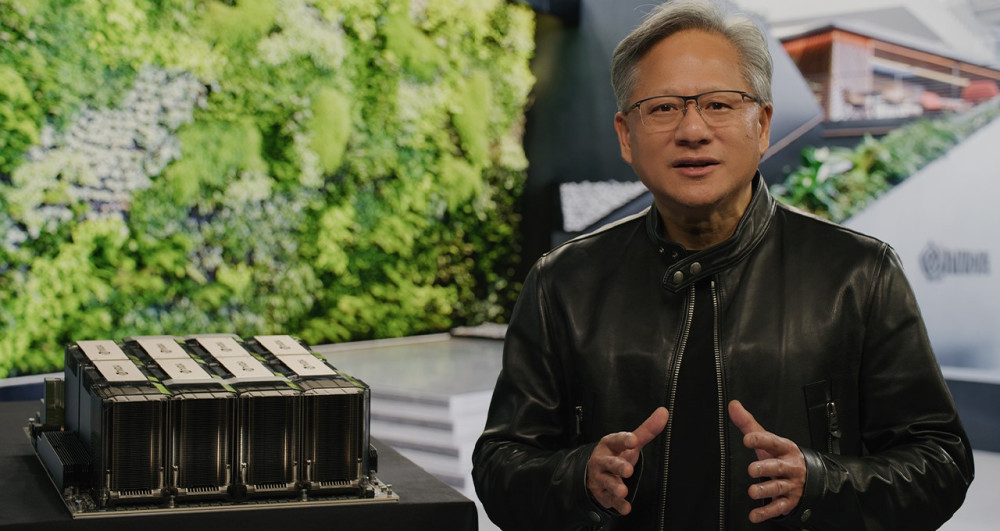

2006 年,戴維·柯克說服了英偉達創始人兼 CEO 黃仁勳推出了 CUDA(Compute Unified Device Architecture,統一計算架構)。

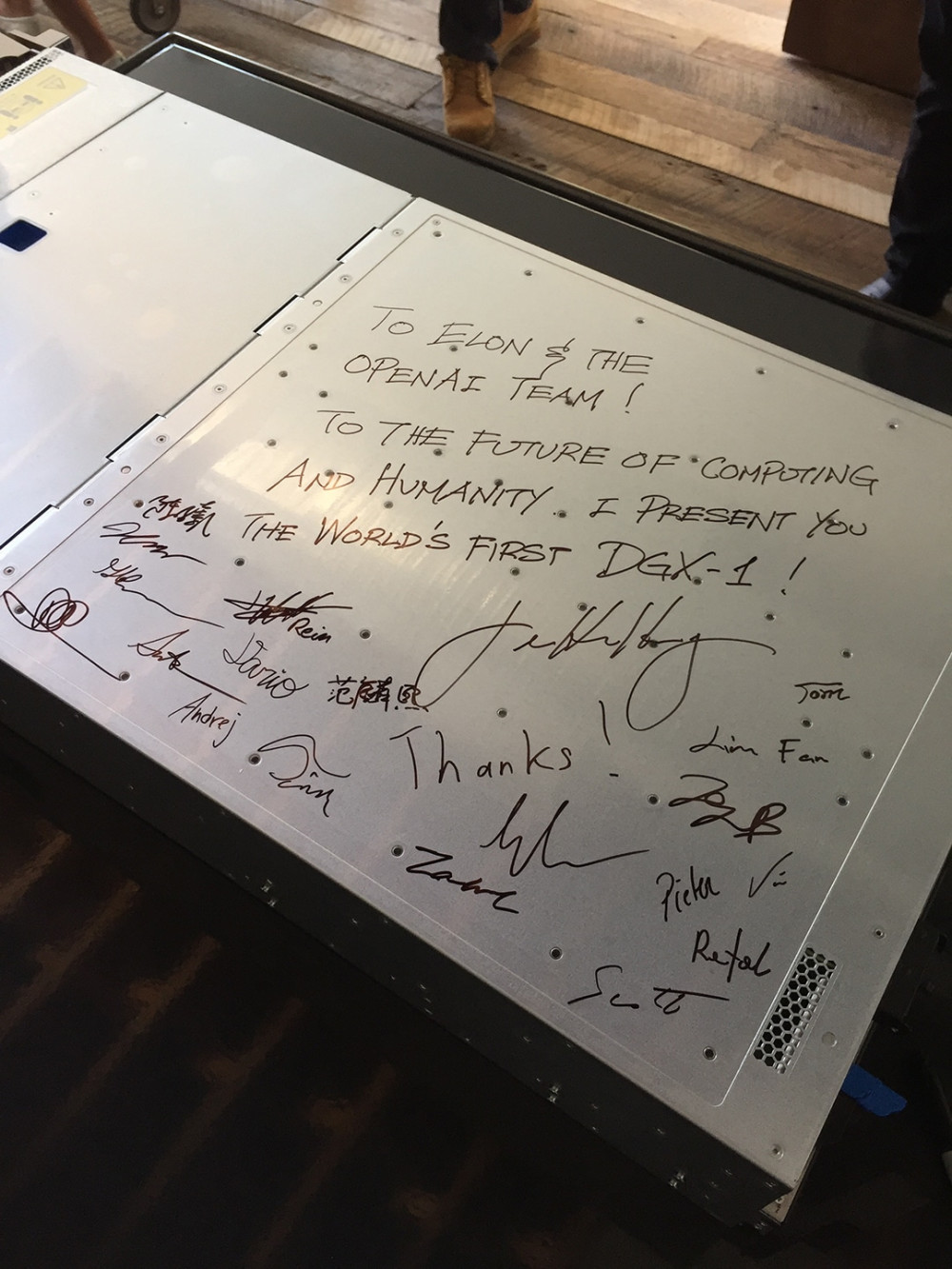

CUDA 的今天從來不是一蹴而就的,而是老黃連續十多年堅定的投入才實現的。從遊戲、科學研究到區塊鏈、挖礦,再到元宇宙以及今天的生成式 AI,老黃不斷爲 CUDA 和 GPU 算力尋找計算的出口和未來,包括在 2016 向剛剛成立的 OpenAI 捐出英偉達的第一台 AI 超級計算機——DGX-1。

黃仁勳,圖/英偉達

正如多年前老黃給俄勒岡州立大學畢業生的寄語:「當有人全力以赴時,他們就能做你做不到的事情。全力以赴,不留後手。」

而很多人並不知道,早在去年 ChatGPT 推出之前,英偉達的數據中心收入就超過了遊戲業務,在 ChatGPT 引爆全球科技行業之後,數據中心業務更是如同开掛般持續增長,完全壓過了來自遊戲玩家的收入。

但王權沒有永恆。

大模型的興起創造了海量的算力需求,英偉達的高端 GPU 幾乎成爲了全球科技公司的首選目標。但首先,英偉達一家公司難以滿足全球市場(以中美爲主)對於 AI 算力的需求;其次,不管從風險控制還是成本角度考慮,大公司在長期來看都不會接受「把雞蛋放在一個籃子」。

最後,算力市場從來不缺競爭者,也並非贏家通喫,至少蘇媽就認爲,「這個市場將會有多個贏家。」

蘇姿豐,圖/ AMD

事實上除了英偉達,另一家芯片巨頭博通也是大模型浪潮的幕後贏家。更遑論,還有以谷歌爲代表的雲計算巨頭,正在試圖垂直整合,實現從底層芯片到訓練框架的自研。

同時就像前文所述,英偉達一家公司難以滿足全球持續增長又不斷變化的算力需求,而 AMD、谷歌、微軟、亞馬遜以及更多公司的加入,將會徹底改變算力的供給,提供更強大、更便宜的算力,才可能真正讓大模型成爲「社會基礎設施」。

老黃會樂見這樣的變化嗎?很難講,但至少在送出那台贈送給 OpenAI 的超級計算機時,他還在上面寫了一句話:

「爲了計算和人類的未來,我向你們獻上世界上第一台 DGX-1。」

圖/英偉達

來源:雷科技

原文標題 : GPT付費訂閱再度开放,AI界的「石油危機」解決了?

標題:GPT付費訂閱再度开放,AI界的「石油危機」解決了?

地址:https://www.utechfun.com/post/304433.html