前言:

智算時代,算力是生產力,數據是核心生產要素,大型語言模型橫空出世後,對數據存儲提出更高的要求。

作者 | 方文三

圖片來源 | 網 絡

大模型時代華爲的AI存儲新品

近日,華爲發布大模型時代AI存儲新品,爲基礎模型訓練、行業模型訓練,細分場景模型訓練推理提供存儲最優解,釋放AI新動能。

華爲發布的“OceanStor A310深度學習數據湖存儲”與“FusionCube A3000 訓/推超融合一體機”是商用AI存儲新品。

官方稱“這兩款產品可爲AI基礎模型訓練、行業模型訓練,細分場景模型訓練推理提供新動能。

OceanStor A310深度學習數據湖存儲,主要面向基礎/行業大模型數據湖場景,實現從數據歸集、預處理到模型訓練、推理應用的AI全流程海量數據管理。

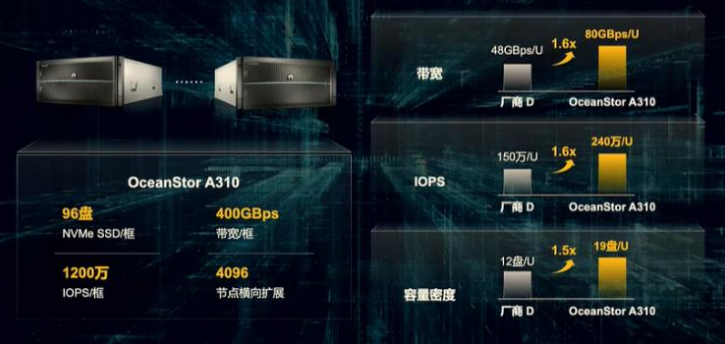

OceanStor A310單框5U支持業界最高的400GB/s帶寬,以及1200萬IOPS的最高性能,可线性擴展至4096節點,可實現多協議無損互通。全局文件系統GFS實現跨地域智能數據編織,簡化數據歸集流程,通過近存計算實現近數據預處理,減少數據搬移,預處理效率提升30 %。

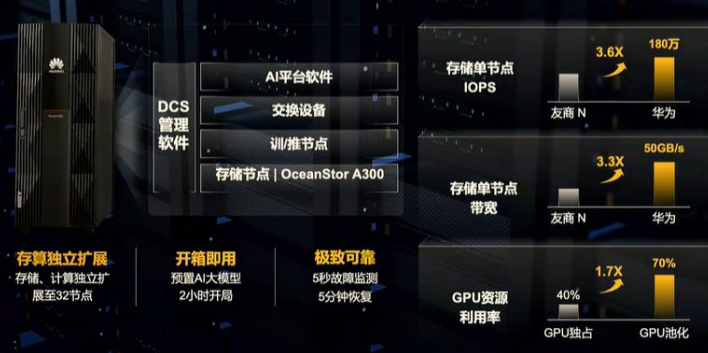

FusionCube A3000訓/推超融合一體機,主要面向行業大模型訓練/推理場景,針對百億級模型應用,集成OceanStor A300高性能存儲節點、訓/推節點、交換設備、AI平台軟件與管理運維軟件,爲大模型夥伴提供拎包入住式的部署體驗,實現一站式“开箱即用”交付,2小時內即可完成部署。

並且該一體機支持兩種靈活的商業模式,包括華爲昇騰一站式方案,以及开放計算、網絡、AI平台軟件的第三方夥伴一站式方案。

一體機的訓/推節點與存儲節點均可獨立水平擴展,以匹配不同規模的模型需求。

同時 FusionCube A3000通過高性能容器實現多個模型訓練推理任務共享GPU,將資源利用率從40%提升到70%以上。

潮流挺進,構建中國AI“新賽道”

ChatGPT的成功並不是偶然結果,在目前版本开放以前,OpenAI已經在訓練大規模語言模型的道路上深耕多年。

目前在國內政策層面,除了在“十四五”期間,針對人工智能的未來發展陸續出台相關指導方案和激勵支持政策。

北京5月30日發布《北京市加快建設具有全球影響力的人工智能創新策源地實施方案(2023-2025年)年》和《北京市促進通用人工智能創新發展的若幹措施》;

深圳5月31日發布《深圳市加快推動人工智能高質量發展高水平應用行動方案(2023-2024年)》;

成都6月5日發布《成都市關於進一步促進人工智能產業高質量發展的若千政策措施(徵求意見稿)》;

杭州6月12日發布《關於加快推進人工智能產業創新發展的實施意見 (徵求意見稿) 》;

無錫6月14日發布《無錫市人工智能產業創新發展三年行動計劃(2023-2025)》;

上海7月8日發布《上海市推動人工智能大模型創新發展的若幹措施》;

重慶7月25日發布《重慶市以場景驅動人工智能產業高質量發展行動計劃(2023-2025)年》。

2023年全國兩會期間,多位全國人大代表、全國政協委員將視野聚焦“如何發展中國自己的ChatGPT”,爲人工智能的發展獻言獻策。

全國人大代表、科大訊飛董事長劉慶峰表示,應當加快推進我國認知智能大模型建設,在自主可控平台上讓行業盡快享受AI紅利,讓每個人擁有AI助手。

全國政協委員錢家盛則建議加大人工智能科學與技術交叉學科建設,穩步推進“人工智能+學科群”培養模式,構建人工智能領域人才培養體系和科技創新體系。

出品大模型應用面臨四大挑战

第一:數據准備時間長,數據來源分散,歸集慢,預處理百TB數據需10天左右;

第二:多模態大模型以海量文本、圖片爲訓練集,當前海量小文件的加載速度不足100MB/s,訓練集加載效率低;

第三:大模型參數頻繁調優,訓練平台不穩定,平均約2天出現一次訓練中斷,需要Checkpoint機制恢復訓練,故障恢復耗時超過一天;

第四:大模型實施門檻高,系統搭建繁雜,資源調度難,GPU資源利用率通常不到40%。

目前大模型對存儲的需求

現階段大模型以文本型的單模態爲主,但是隨着大模型與各個行業相結合,紫東太初大模型、訊飛星火大模型、ChatGLM認知大模型等,都提到過以後會加速多模態的發展,那么數據類型將日益增加。

當然對存儲的要求也會變高,一是要完成基於海量多態數據的訓練;二是要面向海量終端的數據應用。若存儲容量不足可能對模型性能產生影響。

從文本到圖片、音頻、視頻進行拓展,數據量也將大幅增加,預計會從純文本型的幾個TB(太字節、1TB=1024GB)向多模態的PB級(拍字節、1PB=100萬GB)容量邁進,這對存儲的架構、性能等核心能力提出更高要求。

據相關機構預計,2026年中國人工智能軟件及應用市場規模將會達到211億美元,國內被寄予厚望的各大科技公司都在不斷探索大模型運行的新方法、新模式。

然而,只有落地才能實現大模型的價值。

結尾:

數據、算法、算力是AI發展的驅動力,大模型增強了AI技術的通用性,助力AI的實現。

未來,大模型與場景深度融合,配合專業工具和平台支持應用落地,以开放的生態來激發創新,形成良性循環,並通過提供全流程支持應用落地的工具和方法,讓更多企業受益。

內容參考來源於:華爲:華爲發布大模型時代AI存儲新品;浦銀國際研究:從華爲AI存儲新品看大模型時代的存儲趨勢;中國新聞網:大模型催生多樣化數據處理 數據存儲面臨新要求;醫療科技高峰論壇:大模型的深度與速度

原文標題 : AI芯天下丨趨勢丨從AI存儲新品,看大模型時代的存儲趨勢

標題:從AI存儲新品,看大模型時代的存儲趨勢

地址:https://www.utechfun.com/post/244677.html