SD(Stable Diffusion)是目前最流行的本地部署類AIGC工具,它可以說既簡單又復雜。簡單是因爲完全沒有繪畫功底的用戶也可以做出各種風格的精美圖片,而復雜則是因爲AIGC相對沒有那么“聽話”,想要AI完全按照自己的想法實現內容還是頗有難度的。

此前我們簡單介紹過大家最常用的文生圖,今天就來講一講SD更實用的圖生圖功能。它相比文生圖具有在原圖基礎上更可控、更簡單、更還原等優點,但如果是初次接觸,想要用好還是比較困難的,下面我們就來簡單的講一講如何控制圖生圖中的變量達到想要的效果。

1 模型的選擇 准備工作

在SD中,不同的模型有不同的繪畫風格,相信使用過文生圖的朋友都有體會,有的模型擅長動漫人物、有的擅長真人、有的則擅長風景。

這一點在圖生圖中同樣比較重要,如果選擇人物模型,卻想要生成純風景就非常困難,即便反向詞加上各種限制,大概率出圖後也會有一個奇形怪狀的人物出現。

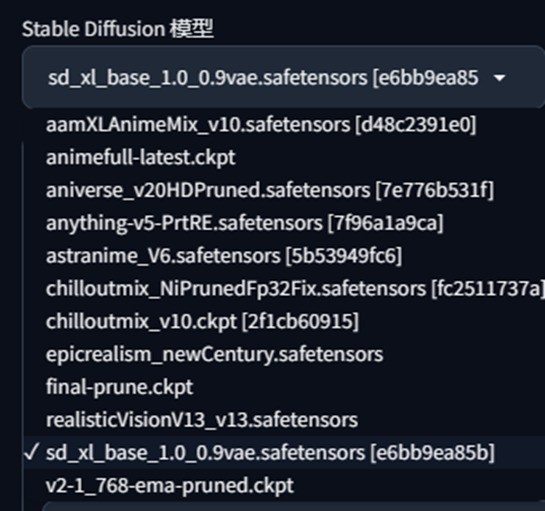

目前從個人使用的情況來看,動漫類aamXLAnimeMix、astranime效果都是不錯的;真人則是chilloutmix;純風景的比較少,使用SDXL即可。

除了模型之外,硬件也是准備工作的重要環節,不管是文生圖還是圖生圖,顯卡始終是衝在最前线的。如果你想生成大尺寸的圖片,顯存是最重要的,如果顯存需求高於實際顯存,則會直接報錯,無法生成。

不過如果你只需生成單張圖片,使用高清修復功能同樣可以解決分辨率的問題。此前筆者由於需要使用SD生成出視頻對應的多張圖片,所以直接按照視頻的尺寸生成了1800×1200分辨率。

對於SD來說,生成簡單的圖12GB顯存大都夠用,如果生成較大較精細的圖片,建議16GB或以上顯存。目前RTX 40系顯卡中RTX 4070 Ti SUPER和RTX 4080 SUPER都是16GB,我們的測試平台使用的爲華碩TUF GeForce RTX 4080 SUPER O16G GAMING顯卡(畢竟收錢了)。

不過在算力上RTX 4080 SUPER也要比RTX 4070 Ti SUPER強很多,10張圖片大約能提升30s左右。畢竟使用SD不管是文生圖還是圖生圖,都是碰運氣的事,驗證階段生成幾十幾百張圖很常見。

2 反推

下面我們直入正題,SD圖生圖與文生圖最大的區別就是需要反推提示詞。雖然SD會自帶反推,但還是建議大家直接下載秋葉大神的整合包,裏面自帶了WD1.4標籤器,傻瓜式操作、速度快、准確度高。

1girl, hat, solo, phone, long hair, cellphone, holding, holding phone, smartphone, blue headwear, realistic, jacket, black hair, upper body, brown hair, baseball cap, grey background, long sleeves, simple background, black eyes

從上圖的反推來看,WD1.4標籤器生成的准確度相當高,而且可一鍵發送到圖生圖,非常方便。

這步不需要什么注意事項,只是在篩選標籤的時候,可以刪除或替換爲自己想要生成的目標。

3 參數設置

在SD圖生圖中,參數的設定和文生圖有些區別,這裏簡單說明。

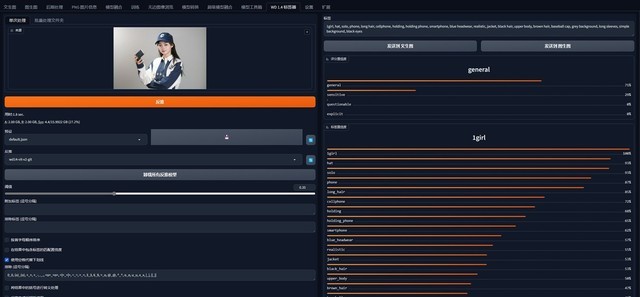

迭代步數

迭代步數的數值與文生圖相同,簡單可以理解爲AI通過多少步的計算得到的這張圖片,通常設定在20-50之間,過低或過高都可能造成畫面崩壞。

然而不同的模型,對迭代步數的需求都不同。通常來講在漫畫模型中,Steps在20左右即可生成不錯的圖片,但很多真人模型Steps 20生成的圖片則會顯得假一些,將數值設定在40-50左右會有不錯的效果。

另外迭代步數越高,生成圖片的時間越慢,反之則快。但最終生成的圖片大小都是相同的。

重繪尺寸

由於SD圖生圖通常是將真實拍攝的照片導入作爲參考,如果是原圖,則需要進行縮放處理,否則會由於圖片過大而顯存報錯。

如果想保持原圖比例,選擇倍數縮放即可;如果想自定義,直接輸入想要的尺寸即可。這一項很簡單,無需太多說明。

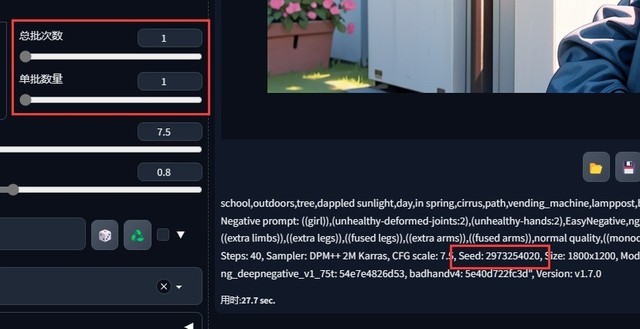

批次

總批次數和單批數量也很好理解,總批次數越大,代表AI隨機種子生成的數量越多;而單批數量則是在同一種子的情況下,使用相同設定生成更多的圖片。

這兩項數值的設定沒有絕對值,通常前期實驗階段的總批次數會多一些,以作爲參考。如果發現了喜歡的風格或構圖,可以查看當前圖片的Seed值,將這個值復制到隨機數種子中(默認爲-1),再生成單批多數量圖片。

引導系數與重繪幅度

這兩項參數是與文生圖區別最大的地方,在文生圖中,提示詞引導系數基本是單一決定出圖效果的變量(除了提示詞)。

而在圖生圖中,引導系數會被極大弱化,它與重繪幅度是相輔相成的關系。

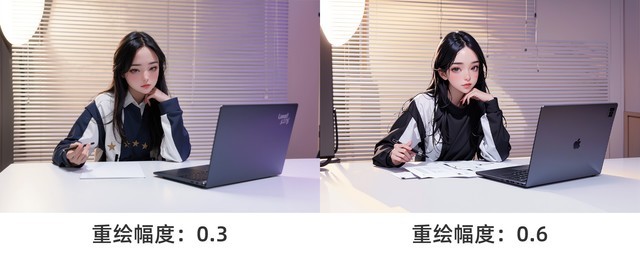

簡單來說,重繪幅度越小,它與原圖就越相似,AI發揮的空間就越小。而重繪幅度在0.5或0.6之後,AI發揮的就越自由。

同時這也會大幅提高畫面崩壞的幾率,雖然AI的自由度高了,但是圖生圖的邏輯仍是在原圖的基礎上修改,所以當兩種設定相衝突時,就會產生崩壞的畫面。

想要得到自己滿意的圖生圖效果,就需要在引導系數與重繪幅度之間反復調試,以掌握自己滿意的AI重繪區間。在掌握了大體的區間後,筆者通常將重繪幅度以0.02作爲步進區間。

4 標籤

雖然圖生圖是以原圖作爲依據進行重繪,但標籤仍然會起到相當大的作用。另外在SD中,一些反向標籤是通用的,大家可以直接復制到記事本中,以便下次直接取用。如果是人物圖片,基本以多余的手、四肢、低質量爲主。

(unhealthy-deformed-joints:2),(unhealthy-hands:2),EasyNegative,ng_deepnegative_v1_75t,(worst quality:2),(low quality:2),(normal quality:2),lowres,bad anatomy,badhandv4,((extra limbs)),((extra legs)),((fused legs)),((extra arms)),((fused arms)),normal quality,((monochrome)),((grayscale)),((watermark)),uneven eyes,lazy eye,(((mutated hand))),

以原圖作爲參考,一些較爲相似的部位,如圖中皖之的頭發、眼神,在重繪幅度較大的情況下,AI可以根據提示詞自行修改。

但身後標志性較強的百葉窗,如果你想讓AI重繪成黑色的櫃子,則很難實現。除非將重繪幅度繼續調大,但隨之而來的後果就是畫面崩壞更嚴重。

所以這時我們就需要用到局部重繪。

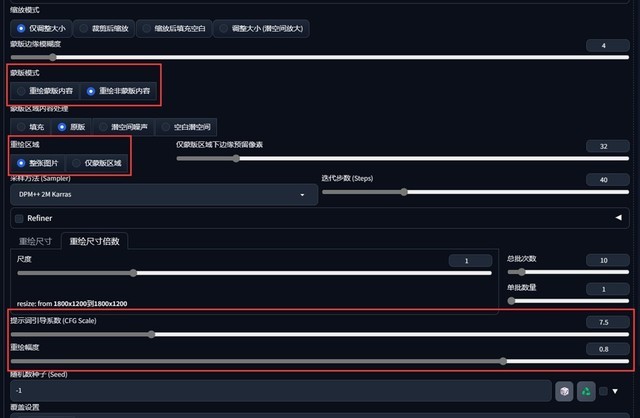

5 局部重繪

蒙版重繪顧名思義,就是圈出圖中需要AI重新生成的地方。它的作用是幫助我們在已經生成出合適的人或背景之後,固定某一區域,重新生成其他區域的內容。

如圖中所示,我們已經生成了相當完美的角色。手部和姿勢都已經相當完美,所以這時候僅需更改背景即可。

重繪的工具SD裏面提供的比較簡單,只有一個圓形畫筆。大家可根據人物結構的不同,隨時調整畫筆大小。

如果想要更嚴謹的區域,也可以上傳原始圖像和黑白蒙版,這樣能夠最大限度保證邊緣結構的准確性。

局部重繪除了框定選區範圍之外,所有參數也要重新設置。畢竟它只是在原圖的基礎上刨除了一部分,仍然相當於重新作畫。

這裏需要注意的是,在蒙版模式中要區分讓AI繪制蒙版內或者反選區域的內容。另外如果需要生成完全不同的背景,在重繪幅度上可以調大參數。

最後就是記得更改提示詞,從標籤頁復制過來的提示詞僅適用於原始圖像,想大幅度改變背景,提示詞需重新定制。

6 總結

圖生圖是SD重非常有用的一項功能,而且它相比文生圖效果更直接。大家不妨找一些身邊的朋友,把他們的照片變爲AI風格,一定會讓大家嘖嘖稱奇。

另外文中沒有提及【ControlNet】,這是一個功能極強的插件,使用它可以時間自定義姿勢、保障面部表情、手指准確性、給老照片上色、給线稿上色等等。不過相對應的使用起來也比較繁瑣,如果大家想看更多關於AIGC的小技巧,下次我們可以單獨來講一期ControlNet插件。

最後,AIGC生圖永遠不會按照我們大腦想的意志來,只能是無限接近。所以如果想達到最好的效果,還要結合自身的繪畫功底來對圖片進行完善。

標題:AIGC技巧:SD圖生圖 如何控制變量生成想要的效果?

地址:https://www.utechfun.com/post/347530.html