新技術、舊生意。

文丨賀乾明 黃俊傑 邱豪編輯丨黃俊傑 龔方毅

AI 技術的進展解決了困擾蘋果軟件團隊 14 年的難題——做一個配得上 iPad 的計算器應用。

iPad 上沒有計算器嗎?十多年的老用戶也可能一瞬間記憶錯亂,大腦裏閃現一個 iPhone 計算器的樣子。事實上,過去十多年,蘋果平板 “計算機” 的用戶如果要算點東西,得掏出手機或者下載第三方軟件。

蘋果爲第一代 iPad 做了計算器,但在發布前一個月被砍掉。2009 年底,面對創始人喬布斯 “計算器 app 的新設計怎么還沒來” 的追問,當時的蘋果軟件部門負責人拿出了一個把 iPhone 計算器放大到 10 英寸的界面——你知道,喬布斯只會有一種反應。

iPad 發布一年半後,喬布斯去世。又過了一年,蘋果軟件部門的負責人因爲地圖的失敗被 CEO 蒂姆·庫克开除。接手的蘋果軟件工程副總裁克雷格·費德裏吉(Craig Federighi)覺得商店裏已經很多第三方的計算器,如果蘋果內置一個,就得做成 “最好的 iPad 計算器”。一等就是 14 年。

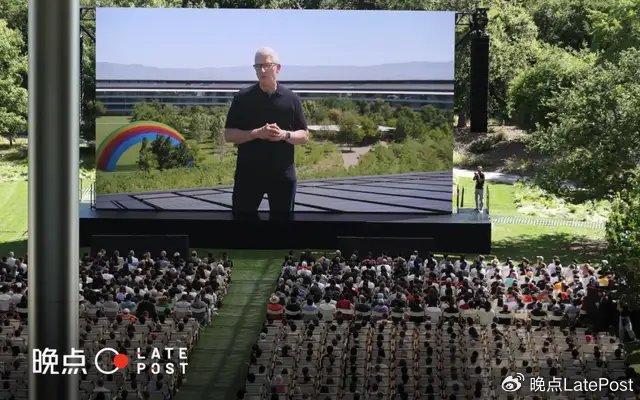

美國當地時間 6 月 10 日上午,WWDC 全球开發者大會上,當費德裏吉宣布 iPad 終於有計算器的時候,在蘋果總部現場的开發者們發出一片歡呼,一开始可能只是意外於蘋果還想着這東西,但隨着演示進行,他們相信蘋果真的拿出了最好的計算器。

iPad 的計算器會識別屏幕上的手寫數學公式,寫下等號就會出現答案,再調整公式,答案自動改變;列出一組數據,劃一道线,它會自動求和;寫下方程式,它能自動生成圖表。

借這個演示,蘋果不僅再次展示了他們對一個好軟件的標准,也展示了他們對 AI 應用的理解——不是獨立存在的產品(Siri 除外),只是作爲功能融入在具體使用場景裏。

面向用戶的 AI 體驗:從新 Siri 到生成圖片,更看重簡單、有用

到 WWDC 主旨演講的第 65 分鐘,在十多位演講者提了幾次機器學習後,蘋果終於帶出被其稱爲個人智能系統(personal intelligence system)的 Apple Intelligence。在進一步說明這套系統如何運作前,蘋果 CEO 蒂姆·庫克(Tim Cook)提出开發這套系統的五大原則:

- 強大(Powerful),它必須足夠有用,幫助你完成最重要的事情。

- 直觀(Intuitive),它必須易於使用。

- 整合(Integrated),它必須集成到產品體驗中。

- 個性化(Personal),它必須了解你,並以你的個人信息爲基礎,例如你的日常習慣、你的人際關系、你的溝通方式等。

- 隱私(Privacy),它必須從一开始就以保護隱私爲基礎構建。

之後的 30 多分鐘內,蘋果分別介紹 Apple Intelligence 如何在 iPhone、iPad 和 Mac 三種硬件平台上,從操作系統滲入到各種應用中的四個應用場景:

新 Siri:看遍數據,理解你在說什么

用戶現在每天向 Siri 發起的請求達到 15 億次。這是一個難堪的數字,意味着平均每人每天只和 Siri 說不到兩句話。2011 年發布以來,它始終沒有成爲一個合格的智能助手。

Siri 不夠聰明,是因爲它的底層技術很大程度上基於規則,用關鍵詞篩選用戶的需求,遇到不能理解的問題就直接展示一個網頁。現在借助大模型,Siri 能夠更准確地理解用戶的提問,而且還可以 “讀懂” 用戶 iPhone 的操作界面,記住之前提到的內容,更好地處理用戶的需求。

它既可以回答數千個有關如何在 iPhone、iPad 和 Mac 上執行操作的問題,比如切換到深色模式,也可以在蘋果和第三方开發的應用中執行數百種操作,比如 “把周六燒烤的照片發給 XXX”;甚至可以自動搜索郵件、照片、短信中的信息回答問題,比如 “播放 XXX 推薦的播客”“XXX 推薦的書單是什么”。

Siri 從圖片、信息、郵件等應用中搜索圖片和特定信息。

OpenAI 的 ChatGPT 也被整合到 Siri 中。如果遇到復雜的問題,比如 “用三文魚、檸檬和西紅柿做五種不同味道的菜”,Siri 會提示用戶是否使用 ChatGPT 回答問題。ChatGPT 默認使用 OpenAI 最新發布的 GPT-4o 模型。

寫作工具:嵌入所有應用,只是助手

蘋果將在 iOS 18、iPadOS 18 以及 macOS Sequoia 中內置由大模型驅動的的寫作工具,幾乎覆蓋所有涉及文本輸入的原生和三方應用,比如郵件、備忘錄等。用戶可以借助它重寫、潤色、校對原文本,但不能憑空生成內容 —— 除非調用 ChatGPT。

歸納總結:深入系統,整理各種信息

首先是對長郵件、文本或者網頁的總結歸納,其次是根據用戶描述自動挑選出圖片,配上背景音樂制作成回憶視頻,以及對通話錄音在內的錄音文件轉寫、要點陳列。是的,蘋果終於解決了一個老問題 —— 支持通話錄音 —— 方案也很有蘋果特色:當用戶开啓錄音時,會自動提醒對方。

這裏提到的 “總結” 不局限於具體應用,還包括對日常海量通知推送的整理,將系統認爲對用戶最重要的信息放在顯眼位置。

生成圖片:操作直觀,但效果堪憂

只支持動畫、插畫和线條圖三種風格,一眼就能看出不是真實場景。蘋果設想它主要的使用場景是與人聊天和記筆記時生成插圖。蘋果更強調可用性,比如在筆記應用中生成圖片時,大模型會默認把周圍的文本當做提示詞一起理解,生成符合上下文的圖片。

蘋果本地大模型根據照片和頁面中的文字信息生成的 “超人母親” 圖片。

2018 年蘋果推出捏臉制作表情包的 Memoji,這次新增根據文字敘述和照片生成 emoji 的功能 Genmoji。相比六年前的 Memoji,Genmoji 更容易做出來、但風格不再統一,也少了幾分靈動,更像是你打开 QQ 會看到的選項。

左圖是蘋果最新的 Genmoji 功能生成的表情,右圖是蘋果 2018 年發布 Memoji 功能 “捏” 出來的表情。

單就功能而言,Apple Intelligence 現在所能實現的並沒有超出其它大模型的能力範疇。蘋果的強項在於多應用和多設備場景的整合、無縫的體驗,以及基於設備中的個人信息去理解用戶指令、輸出解決方案。

按照蘋果的說法,Apple Intelligence 在理解深層次個人場景的同時,也會做到對用戶隱私的保護,比如在設備端處理任務。當聯網以處理需要更多處理能力的請求時,會將其覆蓋於私密雲計算(Private Cloud Compute)之下。

它還在开發各種 API,讓第三方开發者接入這個高度整合的體系。這是相對傳統的做法。老對手微軟則是打算每 5 秒截一次屏幕,“記住” 用戶過去 3 個月內在設備上用過什么程序、處理過什么內容。

根據庫克介紹,今年夏天,蘋果會开始測試美式英語版本的大模型功能,秋季上线,一年後支持其他語言的版本。

從本地部署到調用 GPT-4o,把大模型分成三層

爲了實現庫克提到的五個核心選擇,蘋果設計了一個三層的大模型架構,只有在最後一步才會調用 OpenAI 的 ChatGPT:

1、手機、電腦本地計算,小模型、不聯網

處理 AI 工作時,蘋果會優先使用設備上內置的大模型,用自帶芯片完成計算。這樣數據完全留在本地,可以保障用戶隱私。不上傳到數據中心計算也可以節省大模型的使用成本。

代價是很多蘋果用戶的手機不支持 Apple Intelligence。目前的硬件要求是 A17 Pro(手機)或 M 系列芯片(平板和電腦)。電腦和平板還好,過去三四年的大部分產品都可以用。但手機目前只有 iPhone 15 Pro 和 15 Pro Max 這兩款可用。

關鍵的變量在於芯片的內存和 AI 算力,它們直接決定了運行大模型的效率。相比 iPhone 14 Pro 和 iPhone 15/15 Plus 的 A16 芯片,A17 Pro 的 AI 算力(神經引擎)從 17 TOPS 翻倍增長至 35 TOPS,內存容量也從 6 GB 升級至 8 GB,可以讓大模型即時訪問和讀取更多數據。

盡管過去一年蘋果投入更多資源研發效果更強、參數規模更小的大模型,它也無法讓本地運行的大模型在兼顧設備續航和效率的情況下完美處理它設想的各種功能,只能在雲端部署參數更大的模型。

“傳統的雲端服務器會存儲你的數據,能在你沒有意識到的情況下,以你不希望的方式使用它。而且你也無法驗證那些聲稱沒濫用你數據的公司是否說了真話。” 蘋果軟件工程高級副總裁克雷格·費德裏吉說。

2、私密雲計算,蘋果自建數據中心、數據不留在網上

蘋果的選擇是自建數據中心以實現私密雲計算。根據多家媒體報道,爲這個數據中心提供算力的是蘋果爲 Mac Pro 台式機設計的 M2 Ultra 芯片。

Apple Intelligence 會自動分析用戶的請求能否在本地運行,如果需要更強的算力,就會調用私密雲計算,只把與任務相關的數據發送到雲端處理,並強調數據不會被儲存,甚至連蘋果自己也看不到這些數據。

除了保證隱私,蘋果用自研的 M2 Ultra 搭建數據中心還可以節約成本,它不用花昂貴代價去找英偉達买成品或找博通定制芯片。據研究機構 Semi Analysis 測算,一塊 M2 Ultra(2 * M2 Max + InFO-L 封裝 + 192 GB LPDDR)的成本約爲 2000 美元,不到一張英偉達 H100 的 1/10。M2 Ultra 一次可以處理 4-6 個用戶調用 700 億參數 Llama 3 的請求,大概率可以更高效地運行蘋果自研的大模型——蘋果並沒有公布它在雲端部署的大模型參數,它在今年 3 月發布的自研大模型論文中,訓練出來最大的模型只有 300 億參數。

但 M2 Ultra 畢竟是爲電腦設計的芯片,即使與其他電腦芯片相比有極強的性能優勢,用到數據中心中缺點依然明顯。受限於芯片架構,它不可能像英偉達 GPU 那樣通過大規模並聯來大幅增強性能,因此無法運行千億參數或更大的模型完成用戶需求。

3、Siri 接入第三方大模型,從 OpenAI 开始

蘋果短時間內很難(也沒必要)做出性能追上 GPT-4o 的大模型,所以就有了第三層大模型:OpenAI 的 GPT-4o。根據蘋果的演示,GPT-4o 被嵌入到了 Siri 和大模型寫作功能中。

當 Siri 認爲一個問題需要 GPT-4o 才能提供更好答案時,就會彈出對話框,用戶點擊確認後才把問題、圖片或文檔等信息發過去處理,然後直接顯示回復,不需要跳轉到 ChatGPT 應用。

嵌入到寫作功能中的 GPT-4o,則需要用戶主動調用,可以從頭編一段故事、生成相應的圖片等。整個過程用戶不需要創建新的 OpenAI 账戶,也不需要下載或打开 ChatGPT,用戶發送過去的數據和請求也不會被 OpenAI 儲存,也不用付費(僅限 GPT-4o 的免費功能)。如果用 OpenAI 账戶,則可以關聯、使用 ChatGPT 的付費功能,而且蘋果設備中處理的問題就會同步其中。

ChatGPT 不會是唯一選項。克雷格·費德裏吉說,蘋果未來還會引入其他的大模型。

新技術、老生意

當所有科技巨頭投入大模型後,Apple Intelligence 是蘋果的答案。

發布會上演示的所有功能都是免費提供。軟件公司、互聯網公司,在做 AI 產品的時候都需要算一下帳,考慮用什么方式獲得收入。蘋果沒有這些顧慮,只要體驗保持領先,10 億多用戶繼續买它的昂貴產品,成本就不是問題。

這次蘋果沒有提出什么全新的大模型功能,從演示也看不出蘋果自制大模型的性能如何。單就圖片生成,可能不如你現在能用的不少大模型。蘋果的更多工作,花在將大模型拆解爲一個個功能,嵌入蘋果生態,能爲軟件开發者所用。

蘋果做 AI 不晚。它在 7 年前發布 Core ML 框架,並且在拍照時引入 AI——用戶按下快門,iPhone 拍下數百張照片,再利用芯片計算,合成最優解給用戶。但蘋果做大模型明顯晚了。ChatGPT 2022 年底上线後的反響超過了所有科技巨頭,也包括 OpenAI 自己的預期。而蘋果是所有科技大公司裏最難快速回應的。

晚本身不是問題。蘋果基本從未第一個發明任何新品類,第一台個人電腦、第一部智能手機、第一個無线耳機都和蘋果無關。但它總能抓住小衆新技術向大衆應用擴散的節點,找到正確的產品形態,再用非凡的工程能力打磨出最吸引人的產品,讓一個新的計算機形態爲大衆所接受。Mac、iPod、iPhone、AirPods……蘋果一次次用超級產品加速了技術普及並拿走一個行業裏的主要利潤,成爲 3 萬億美元市值的公司。

蘋果處於推廣新技術的絕佳位置:全球 80 億人裏,有超過 10 億人使用 iPhone,其中數億人用着蘋果的耳機、音箱、個人電腦,每年總計花近千億美元买蘋果的互聯網服務。這家同時控制軟硬件和互聯網服務生態的公司,可以在幾個月時間裏讓一個技術 7x24 小時地出現在大多數用戶眼前,如果出問題,影響太大。

蘋果的優勢和劣勢都因爲它的規模,它和用戶之間的信任,再沒有第二家公司能這樣整合軟硬件和服務。但它推廣技術越快,就越難承受重大失敗。Apple Intelligence 明顯從安全上做了諸多限制,不論限制圖片生成的類型,還是用自己的處理器搭建私密雲計算,都有這方面考慮。

一個快速發展中的技術,需要試錯才能進化。如果 AI 大模型未來沒有重大突破,接下來只是降低成本、打磨應用場景,蘋果 iPhone + AirPods 的生態幾乎無可動搖。但如果 GPT-4 只是开始,蘋果的問題也才剛剛开始。

題圖來源:視覺中國

標題:蘋果的大模型衝刺:沒有 AI 新產品,只有新功能

地址:https://www.utechfun.com/post/383058.html