這個技術展示Demo讓任何擁有RTX GPU的人都能享受強大的個人定制化的GPT聊天機器人。

在基於NVIDIAGPU 的雲端服務器支持下,全球每天有數百萬人使用聊天機器人。現在這些开創性的工具將出現在搭載NVIDIARTX的WindowsPC 上,以實現本地、快速、信息定制的生成式AI。

Chatwith RTX技術演示版,現已开放免費下載,用戶可在搭載NVIDIAGeForce RTX 30 系列或更高版本的GPU(至少8GB顯存)進行本地部署,打造個人專屬聊天機器人。

問我一切

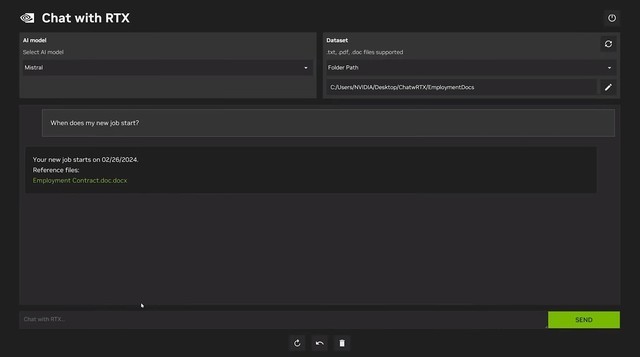

Chatwith RTX 借助檢索增強生成(RAG)、NVIDIA TensorRT-LLM軟件及NVIDIARTX 加速技術,將生成式AI功能引入由GeForce賦能的本地WindowsPC。用戶可快速輕松地將桌面端上的資料當成數據集,連接到Mistral或Llama 2這一類开源大型語言模型,以便快速查詢與上下文有關的內容。

用戶只要輸入查詢內容即可,無需搜尋筆記或儲存的內容。例如用戶可以問:「我的合作夥伴推薦拉斯維加斯的哪家餐廳?」Chatwith RTX 工具就會掃描用戶指向的桌面端資料,並且按照上下文提供答案。

Chatwith RTX 工具支持包括.txt、.pdf、.doc/.docx和.xml在內的多種文件格式。將應用程序指向含有這些資料的文件夾,Chatwith RTX 工具就會在幾秒鐘內將它們載入到資料庫中。

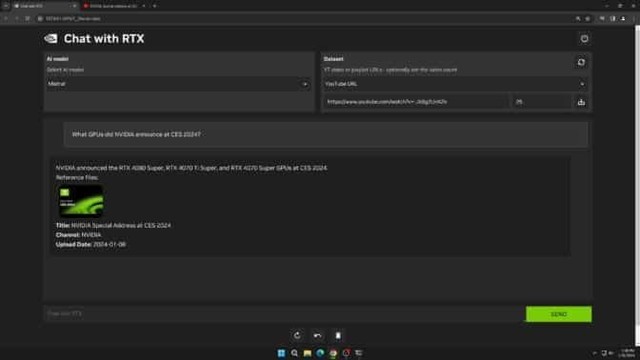

用戶還能加入YouTube視頻和播放列表裏的信息。在Chatwith RTX裏加入視頻網址,用戶便能將這些知識與聊天機器人進行整合,進行上下文查詢。例如根據最喜歡的旅遊KOL所發布的視頻內容來詢問推薦的旅遊內容,或是按照頂尖教育資源獲取快速教學和操作方法。

Chatwith RTX 可以將YouTube影片內容的知識加入查詢結果。

Chatwith RTX 可以在WindowsRTX PC 和工作站上以本地部署的方式運行,再加上用戶的數據還是保留在本地設備裝置上,因此能夠快速提供查詢結果。與依賴雲端環境的LLM服務不同,Chatwith RTX 讓用戶能夠在PC桌面端處理敏感資料,無需分享給第三方或是連接到網絡。

除了需要配備GeForceRTX 30 系列或更高版本的GPU(至少8GB顯存),使用Chatwith RTX 還需要搭配操作系統Windows10 或11和最新的NVIDIAGPU 驅動。

編注:目前Chatwith RTX中存在一個問題,用戶選擇不同的安裝目錄時,會造成安裝失敗。我們將在日後的版本中修復這個問題。目前用戶應使用默認的安裝目錄(「C:\Users\<username>\AppData\Local\NVIDIA\ChatWithRTX」)。

使用RTX开發以LLM爲基礎的應用

Chatwith RTX 展現出利用RTXGPU 加速LLM的潛力。這款應用使用GitHub上的TensorRT-LLMRAG 开發者參考項目構建而成。开發者可以使用該參考項目,爲RTX开發和部署私人以RAG爲基礎的應用,並且由TensorRT-LLM進行加速。深入了解如何建立以LLM爲基礎的應用。

深入了解 Chatwith RTX:https://www.nvidia.com/en-us/ai-on-rtx/chat-with-rtx-generative-ai/

標題:Chat With RTX 爲 NVIDIA RTX AI PC 信息定制聊天機器人

地址:https://www.utechfun.com/post/333501.html