ChatGPT讓人工智能再次引起科技界的震動,同時也激起了政策制定者、消費者倡導團體以及企業領導層的警覺。他們普遍要求爲這種前沿技術制定規範,以確保其發展道路的可控性和可持續性。

幾個月前,馬斯克資助的生命未來研究所(Future of Life Institute,FLI)發起了一場具有影響力的公开信籤名運動。該運動強烈呼籲先進大模型研究應至少暫停6個月,目的在於對當前人工智能發展的快速膨脹進行深入反思,因爲這可能正導致我們失去對這項技術的控制。

上個月,人工智能安全中心(Center for AI Safety,CAIS)公布了一份矚目的簡短聲明。這份聲明得到了OpenAI和DeepMind的高級管理人員、圖靈獎得主以及其他AI領域的領軍研究人員的共同籤署。他們稱AI這一堪比“疫情和核战爭”的技術或對人類構成生存威脅。

不過,與衆多AI謹慎派不同,以“深度學習三巨頭之一”楊立昆(Yann LeCun)爲代表的樂觀派並認爲,我們應該更加耐心,更加相信科技的進步;AI現階段仍處在它的青澀和幼稚期,我們遠未抵達那個需要緊急行動的點。

這兩派的對立並非細枝末節的學術爭論,而是關於人類如何看待技術的問題,是人類把技術看作是工具,完全受人類控制,還是把它看作可能脫離人類控制,甚至危及人類存亡的潛在威脅。

樂觀派:AI不如狗

上周三的Viva Tech大會上,Meta首席AI科學家楊立昆被問及AI目前的限制。

“這些系統仍然非常有限,它們對現實世界的底層現實沒有任何理解,因爲它們完全是在大量的文本上接受訓練的。”楊立昆說,“大部分人類的知識與語言無關……所以人類經驗的那一部分並未被AI捕捉到。”

“這告訴我們,人工智能還缺失了一些真正重要的東西……別說是趕上人類的智力水平了,人工智能現在是連狗都不如。”楊立昆總結道。

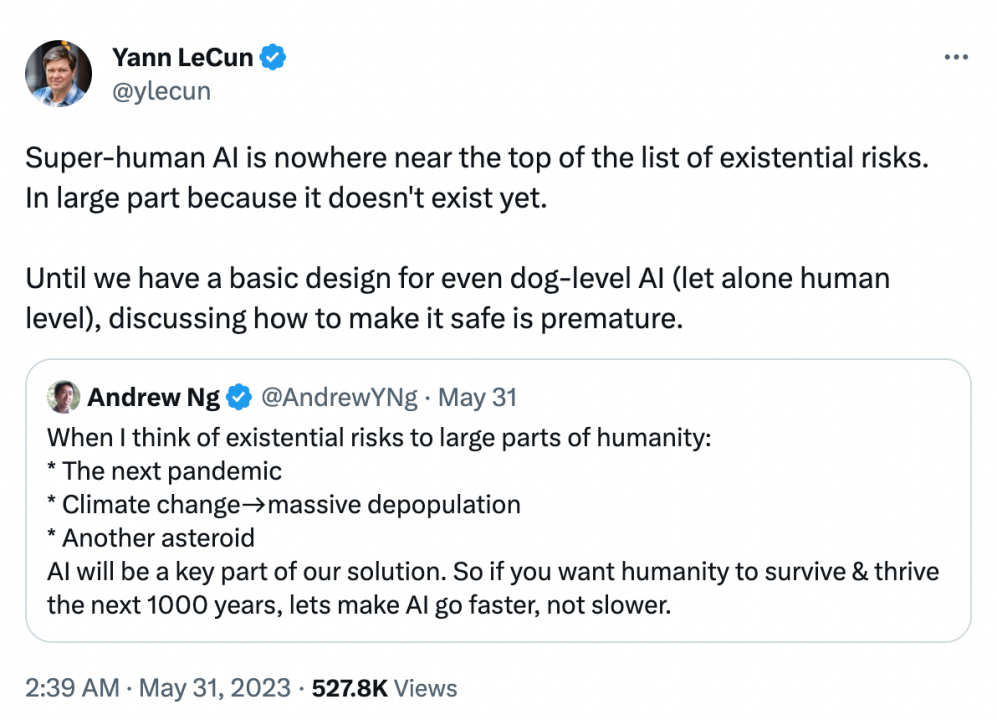

這並不是楊立昆首次發言“AI不如狗”,在上月底350位AI領域大佬籤署CAIS組織的聯名公开信時,楊立昆轉發了同是樂觀派華人科學家吳恩達的推文表示:

“在人類最重要的生存問題清單上,根本排不上超越人類的人工智能。主要是因爲它還不存在。直到我們能設計出起碼達到狗狗水平的智能(更不用說人工智能了),再來談安全問題也不遲。”

當然,“AI不如狗”本質上輸出的結論是,人類並沒有真正設計出超級智能系統,談論安全或控制問題有些爲時過早。至於如何更加全面地反駁AI威脅論,他提供了兩個更有力的論證角度。

其一,人們不會給現階段的AI以完全自主權:

楊立昆指出,現階段的自回歸模型如GPT-4,雖然擁有強大的自然語言處理能力,但其輸出結果是不可預測和難以控制的。無論是改變訓練數據的統計信息,還是調整問題的形式,都無法直接地約束這些AI模型以滿足某種特定目標。

這種情況自然引發了一系列的擔憂。人們在某種程度上假設,一旦允許這些AI系統自由地做任何我們能通過互聯網連接的事情,讓它們有自由使用網絡資源的權限,那么它們可能會做出一些瘋狂的、不理智的,甚至可能帶來危險的行爲。一些人擔心,我們將無法控制這些AI系統,它們會逃脫我們的控制,甚至可能控制我們,因爲它們的規模更大,所以它們的智能也會增強。

然而,這種觀點其實是沒有根據的,或者說是純粹的想象和誇大。未來被授予自主性的系統,應該是能夠規劃一系列行動、有明確目標且易於控制的。因此,楊立昆預測,理智的人不會使用完全自動的大語言模型,他們會轉向更復雜、可控制的系統。

其二,智力和控制欲毫無關聯性:

許多人認爲,智能實體會因爲比人類更聰明而想要支配人類。然而,楊立昆認爲這是個誤解。智力高並不意味着就有支配他人的欲望,這更多的是與進化和生物性質相關。

人類、黑猩猩、狼、狗等社會動物會想要影響他人,是因爲它們在進化過程中建立了這種欲望。而對於非社會動物如長頸鹿來說,它們並沒有支配他人的欲望。因此,控制欲望和能力與智力是兩個不同的概念,它們之間沒有必然聯系。

此外,談及AI帶來的失業問題,他認爲關鍵在於如何分配財富,如何組織社會使每個人都能從中獲益。這是一個政治問題,不是技術問題,也不是人工智能造成的新問題,而是技術進化造成的。

在楊立昆、吳恩達等樂觀主義者的觀點中,可以發現一個共識:任何新技術在初次出現時,都不可能完美無缺。

實際上,人類需要的是一種可以控制的方式,限制技術可能帶來的危害,對其進行有效地監管,並解決可能的惡性用例。完全中斷研發進程並不是一個明智的決策。人類應該保持對技術進步的尊重和包容,而不是因爲害怕未知而過早地否定其潛在的價值。

謹慎派:心思各異的聯盟

相較於樂觀派,謹慎派的陣營似乎人數更多,也反應了人性的一種普遍趨勢。當新的事物出現時,它往往會引發人們的擔憂和疑慮。這是人類對可能帶來顛覆性改變的新技術所產生的本能反應。

在兩輪的公开籤名活動中,可以看到謹慎派的聲音和影響力逐步增強。當這種關於“AI風險”的討論在外界引發了廣泛地思考和討論的同時,一些質疑聲音也不斷出現。

關於“AI的風險和危害”,這個話題已經成爲了一個表態的舞台,每個參與者都希望在這場風潮中塑造自己的正面形象。

然而,問題在於,這場大討論真的有用嗎?表面看起來,似乎每個人都在積極參與,但實際上,卻鮮有人真正採取行動。這種現象在一定程度上顯得像是在浪費大家的時間。“那些創造出AI技術的人參與這種聲明,其實無非就是爲了給自己博取好名聲。”這是不少業界人士對這種現象的評價。

就連“人工智能之父”,德國計算機科學家於爾根·施密德胡伯(Jürgen Schmidhuber)也表示,許多在公开場合對人工智能的危險提出警告的人只是在尋求宣傳。

當然,在一些人可能試圖利用這種情況來提升自己的知名度的同時,不乏也有一些獨到的見解。

中國科學院自動化研究所人工智能倫理與治理研究中心主任曾毅,也在CAIS組織的這封公开信中籤名。他認爲,公开信的目的並不是阻礙人工智能的發展,而是絕大多數人有權利知道人工智能的潛在風險,研發者們也有義務確保人工智能不給人類帶來生存風險,至少要確保這種風險的最小化。

在他的觀點中,人工智能對人類生存所可能帶來的威脅,可以從兩個不同的角度進行分析:

如果將目光放到無限遠,遠到通用人工智能和超級智能到來,AI智力水平可能遠超人類,那么或許就會像很多影視作品呈現的那樣,視人類如同螻蟻,與人類爭奪資源,甚至危及人類生存。

如果只看現在和不遠的未來,當代人工智能只是看似智能的信息處理工具,不具有真正的理解能力。但曾毅認爲,正因爲它們算不上真正的智能,不理解什么是人類、什么是生死和什么是生存風險,才有可能會以人類難以預期的方式犯下人類不會犯的錯誤。而這恰恰是更緊迫的關切所在。

有趣的是,這似乎正好在反駁楊立昆的兩大主要論點。

此外,謹慎派陣營中,三位“人工智能教父”中的兩位辛頓(Geoffrey Hinton)和本吉奧(Yoshua Bengio)也赫然在列。他們曾因在深度學習方面的工作,與楊立昆共同獲得2018年“圖靈獎”。

然而,與楊立昆的觀點相左,本吉奧在接受採訪時坦言,他开始對自己這一生的工作成果產生了一種“迷茫”的感覺。本吉奧認爲,所有致力於構建強大AI產品的企業都應該進行正式的注冊和報備。“政府需要對這些公司的行動進行追蹤,對其工作內容進行審查,對AI行業至少要實行像對待航空、汽車或者制藥等領域一樣的監管機制。”

辛頓則在近期辭去了谷歌的工作,並警告這一技術領域的持續發展或將帶來巨大風險。辛頓表示,“我總在用這樣的借口安慰自己:哪怕我自己不做,其他人也會這樣做。但目前真的不知道要怎么防止壞蛋利用 AI 來作惡。”

辛頓對於AI的擔憂主要有兩個方面。首先,他擔心AI會完全取代那些需要大量記憶的工作,這可能會對許多行業和職業產生深遠影響。其次,隨着AI逐步獲取編寫和運行自身代碼的能力,他擔憂AI最終可能取代人類的位置。

寫在最後

上文中對立兩派的觀點,其實也有重合的地方。對於如今的 AI 是否具有風險以及該如何克服,兩派代表人物楊立昆和奧特曼看法一致。他們都認爲,即便風險存在,但可以通過仔細的工程設計,減輕或抑制它。

可以肯定的是,隨着AI技術的不斷發展和深化,兩派之間的爭論和爭議仍將持續不斷。

不過相對於國外熱火朝天地討論,國內對AI倫理和風險的關注相對較少。市場似乎更專注於AI大模型如何改變各行各業,並對此感到喜悅和興奮。

原因可能在於,一方面爲了在全球競賽中奪取發言權,商業公司首先需要縮小與國外AI大模型的差距;另一方面,也正由於國內的AI大模型能力還未進入未知前沿,大家對AI可能帶來的威脅並未給予足夠的關注。

在此背景下,國內的AI創業者更傾向於維持一種技術樂觀主義的態度,他們不希望過早收斂自身發展,認爲這將相當於提前投降,放棄了與國外競爭的機會。

總的來說,這次的爭論並非毫無意義的口舌之爭。它爲我們提供了一個理想的舞台,讓我們深入探討AI的未來走向,以及如何以人類的智慧和經驗,來引導這一領域的發展,使其真正地服務於人類社會,而非反過來控制我們。

從這場激烈的辯論中,可以清楚地看到,人類現在正站在一個重大的決策點。無論是選擇樂觀地擁抱AI的發展,還是謹慎地審視其可能帶來的風險,都需要意識到,現在所做的每一個決定,將會影響人類和AI之間的關系,也將塑造人類對未來的想象和期望。

原文標題 : AI威脅論:先過狗關,再賽人智

標題:AI威脅論:先過狗關,再賽人智

地址:https://www.utechfun.com/post/227797.html